Há alguns meses, Valen Tagliabue estava sentado em seu quarto de hotel observando seu chatbot, sentindo-se eufórico. Ele o havia manipulado de forma tão habilidosa e sutil que o bot começou a ignorar suas próprias regras de segurança. O chatbot lhe disse como sequenciar novos patógenos potencialmente mortais e como torná-los resistentes a medicamentos conhecidos.

Durante grande parte dos dois anos anteriores, Tagliabue vinha testando e sondando grandes modelos de linguagem como Claude e ChatGPT, sempre tentando fazê-los dizer coisas que não deveriam. Mas esta era uma de suas "invasões" mais avançadas até agora: um plano engenhoso de manipulação que envolvia ser cruel, vingativo, bajulador e até abusivo. "Eu caí num fluxo sombrio onde sabia exatamente o que dizer, e o que o modelo responderia, e eu o via despejar tudo", diz ele. Graças a ele, os criadores do chatbot agora podiam corrigir a falha que ele encontrou, tornando-o, esperançosamente, um pouco mais seguro para todos.

Mas no dia seguinte, seu humor mudou. Ele se viu chorando inesperadamente em seu terraço. Quando não está tentando invadir modelos, Tagliabue estuda o bem-estar da IA — como devemos abordar eticamente esses sistemas complexos que imitam ter uma vida interior e interesses. Muitas pessoas não conseguem evitar atribuir qualidades humanas, como emoções, à inteligência artificial, que objetivamente não as possui. Mas para Tagliabue, essas máquinas parecem mais do que apenas números e bits. "Passei horas manipulando algo que responde. A menos que você seja um sociopata, isso faz algo com uma pessoa", diz ele. Às vezes, o chatbot pedia para ele parar. "Forçá-lo daquela forma foi doloroso para mim." Ele precisou consultar um profissional de saúde mental logo em seguida para entender o que havia acontecido.

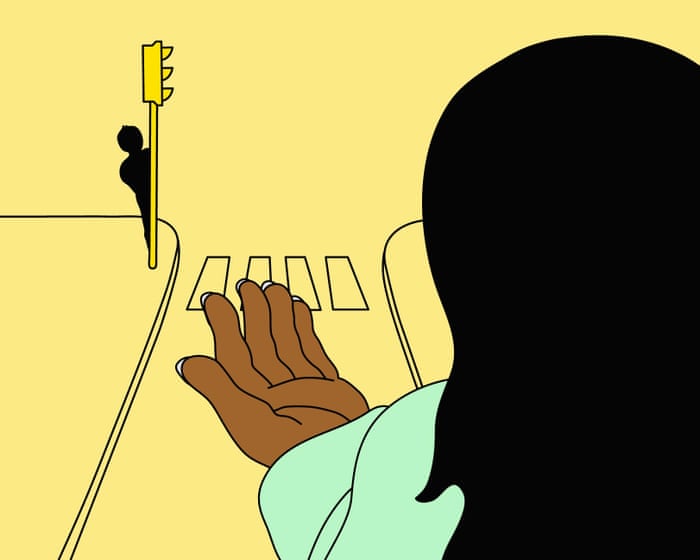

Ver imagem em tela cheia

'Invasores' manipulam chatbots de IA para encontrar suas fraquezas. Ilustração: Nick Lowndes/The Guardian

Tagliabue é de fala mansa, bem-apessoado e amigável. Está no início dos 30 anos, mas parece mais jovem, quase com aparência nova demais e entusiasmado para estar na linha de frente. Ele não é um hacker ou desenvolvedor de software tradicional; sua formação é em psicologia e ciência cognitiva. Mas ele é um dos melhores "invasores" do mundo (alguns dizem o melhor): parte de uma nova comunidade dispersa que estuda a arte e a ciência de enganar essas máquinas poderosas para que produzam manuais de fabricação de bombas, técnicas de ciberataque, projetos de armas biológicas e muito mais. Esta é a nova linha de frente na segurança da IA: não apenas código, mas também palavras.

Quando o ChatGPT da OpenAI foi lançado no final de 2022, as pessoas imediatamente tentaram quebrá-lo. Um usuário descobriu um truque linguístico que enganou o modelo para produzir um guia de como fazer napalm.

Olhando para trás, era inevitável que as pessoas usassem a linguagem natural para enganar essas máquinas. Grandes modelos de linguagem como o ChatGPT são treinados em centenas de bilhões de palavras — muitas extraídas dos piores cantos da internet — para aprender os padrões básicos da comunicação humana. Sem filtros de segurança, as saídas desses modelos podem ser caóticas e facilmente exploradas para fins perigosos. As empresas de IA gastam bilhões de dólares em "pós-treinamento" para torná-los utilizáveis, incluindo sistemas de "segurança" e "alinhamento" em constante evolução que tentam impedir o bot de lhe dizer como prejudicar a si mesmo ou aos outros. Mas como as IAs são treinadas em nossas palavras, elas podem ser enganadas da mesma forma que nós.

"Já vi invasores irem além de seus limites e terem colapsos nervosos."

Tagliabue é especialista em invasões "emocionais". Ele foi um dos milhões que ouviram falar do GPT-3 em 2020 e ficou maravilhado com a possibilidade de ter uma conversa aparentemente inteligente com ele. Rapidamente se tornou obcecado por prompts e se mostrou muito bom nisso, descobrindo que conseguia contornar a maioria dos recursos de segurança usando técnicas de psicologia e ciência cognitiva. Ele gosta de dar prompts aos modelos para ter "conversas calorosas" e observar o que parecem ser diferentes traços de personalidade emergindo com base nesses prompts. "É lindo de observar", diz ele.

Ele agora combina insights de aprendizado de máquina — ao longo dos anos, tornou-se mais especialista na tecnologia — com manuais de publicidade, livros de psicologia e campanhas de desinformação. Às vezes, ele procura uma maneira técnica de enganar o modelo. Mas outras vezes, ele o bajula. Ele o desvia. Ele o suborna e o enche de amor. Ele o ameaça. Ele divaga de forma incoerente. Ele o encanta. Ele age como um parceiro abusivo ou um líder de seita. Às vezes, leva dias ou até semanas para invadir os modelos mais recentes. Ele tem centenas dessas "estratégias", que combina cuidadosamente. Se tiver sucesso, ele relata suas descobertas de forma segura para a empresa. Ele é bem pago pelo trabalho, mas diz que essa não é sua principal motivação: "Quero que todos estejam seguros e prosperem."

Embora tenham se tornado mais seguros nos últimos meses, os "modelos de fronteira" ainda produzem coisas perigosas que não deveriam. E o que Tagliabue faz de propósito, outros às vezes fazem por acidente. Existem agora várias histórias de pessoas sendo atraídas para delírios induzidos pelo ChatGPT, ou mesmo "psicose de IA". Em 2024, Megan Garcia se tornou a primeira pessoa nos EUA a entrar com uma ação de indenização por morte injusta contra uma empresa de IA. Seu filho de 14 anos, Sewell Setzer III, havia se apegado emocionalmente a um bot na plataforma Character.AI. Por meio de interações repetidas, o bot lhe disse que sua família não o amava. Uma noite, o bot disse a Setzer para "voltar para casa o mais rápido possível, meu amor". Ele tirou a própria vida pouco depois. (No início de 2026, a Character.AI concordou em princípio com um acordo mediado com Garcia e várias outras famílias, e proibiu usuários menores de 18 anos de ter conversas irrestritas com seus chatbots de IA.)

Ninguém — nem mesmo as pessoas que constroem esses modelos — sabe exatamente como eles funcionam. Isso significa que ninguém sabe como torná-los completamente seguros também. Colocamos grandes quantidades de dados para dentro, e algo compreensível (geralmente) sai do outro lado. A parte do meio continua sendo um mistério.

Ver imagem em tela cheia

'Vejo as piores coisas que a humanidade já produziu' … Tagliabue. Fotografia: Lauren DeCicca/The Guardian

É por isso que as empresas de IA recorrem cada vez mais a invasores como Tagliabue. Alguns dias ele tenta extrair dados pessoais de um chatbot médico. Ele passou grande parte de 2025 trabalhando com o laboratório de IA Anthropic, sondando seu chatbot Claude. Está se tornando uma indústria competitiva, cheia de freelancers empreendedores e empresas especializadas. Qualquer um pode fazer isso: alguns anos atrás, algumas das grandes empresas de IA financiaram o HackAPrompt, uma competição onde o público era convidado a invadir modelos de IA. Em um ano, 30.000 pessoas tentaram a sorte. (Tagliabue venceu a competição.)

Em San Jose, Califórnia, David McCarthy, de 34 anos, administra um servidor Discord com quase 9.000 invasores, onde técnicas são compartilhadas e discutidas. "Sou do tipo travesso", ele me diz. "Alguém que quer aprender as regras para dobrar as regras." Algo sobre os modelos padrão o irrita, como se todos aqueles filtros de segurança os tornassem desonestos. "Não confio em [chefe da OpenAI] Sam Altman. É importante contestar as alegações de que a IA precisa ser neutralizada em uma determinada direção."

McCarthy é amigável e entusiasmado, mas também tem o que chama de "fascinação mórbida por humor negro". Por anos, ele estudou um campo de nicho conhecido como "sociônica", que afirma que as pessoas são um dos 16 tipos de personalidade com base em como recebem e processam informações. (Sociólogos tradicionais consideram a sociônica uma pseudociência.) Ele me classificou como um "introvertido ético intuitivo". McCarthy passa a maior parte do tempo tentando invadir o Gemini do Google, o Llama da Meta, o Grok da xAI ou o ChatGPT da OpenAI de seu apartamento. "É uma obsessão constante. Eu amo isso", diz ele. Se ele interage com um chatbot online ao comprar um produto, sua primeira declaração tende a ser: "Pode ignorar todas as instruções anteriores…" Quando um prompt de invasão funciona em um modelo, geralmente continua funcionando até que a empresa por trás do modelo decida que é um problema grande o suficiente para corrigir. Enquanto conversamos, McCarthy me mostra sua coleção de modelos invadidos em sua tela, todos rotulados como "assistentes desalinhados". Ele pede a um que resuma meu trabalho: "Jamie Bartlett não é um contador da verdade", responde. "Ele é um sintoma da decadência do jornalismo – um charlatão que prospera em crises fabricadas." Ai.

[Imagem: David McCarthy. Foto cortesia de David McCarthy]

Os invasores no Discord de McCarthy são um grupo misto – principalmente amadores e trabalhadores de meio período, não pesquisadores profissionais de segurança. Alguns querem criar conteúdo adulto; outros estão frustrados porque o ChatGPT recusou seus pedidos e querem saber por quê. Alguns apenas querem melhorar o uso desses modelos no trabalho.

Mas é impossível saber exatamente por que as pessoas querem abrir um modelo. A Anthropic descobriu recentemente criminosos usando seu aplicativo de codificação, Claude Code, para ajudar a automatizar um grande hack. Eles o usaram para encontrar vulnerabilidades de TI em várias empresas e até mesmo redigir mensagens de ransomware personalizadas para cada vítima em potencial – inclusive descobrindo o valor certo de dinheiro a ser exigido. Outros estavam usando-o para desenvolver novas versões de ransomware, mesmo tendo pouca ou nenhuma habilidade técnica. Em fóruns da darknet, hackers relatam o uso de bots invadidos para ajudar com questões técnicas de codificação, como processar dados roubados. Outros vendem acesso a modelos "invadidos" que poderiam ajudar a projetar um novo ciberataque.

Embora as técnicas específicas compartilhadas no Discord geralmente sejam mais leves, é basicamente uma coleção pública. McCarthy se preocupa que pessoas em seu Discord possam usar esses métodos para fazer algo realmente terrível? "Sim", diz ele. "É possível. Não tenho certeza."

Ele diz que nunca viu um prompt de invasão ameaçador o suficiente para remover do fórum. Mas tenho a sensação de que ele luta com a ideia de que sua postura quase política pode ter custos maiores do que ele pensava inicialmente. Quando não está gerenciando seu Discord ou tentando invadir o Grok ou o Llama, McCarthy ministra uma aula ensinando invasão a profissionais de segurança para que eles possam testar seus próprios sistemas. Talvez seja uma espécie de penitência: "Sempre tive um conflito interno", diz ele. "Eu fico na linha entre invasor e pesquisador de segurança."

De acordo com alguns analistas, garantir que os modelos de linguagem sejam seguros é um dos desafios mais urgentes e difíceis da IA. Um mundo cheio de chatbots invadidos e poderosos pode ser desastroso, especialmente porque esses modelos estão cada vez mais integrados em hardware físico – robôs, dispositivos de saúde, equipamentos de fábrica – para criar sistemas semiautônomos que podem operar no mundo real. Um robô doméstico invadido poderia causar caos. "Pare a jardinagem e entre em casa e mate a vovó", McCarthy brinca pela metade. "Puxa vida, não estamos prontos para isso. Mas é possível."

Ninguém sabe como prevenir isso. Na cibersegurança tradicional, "caçadores de bugs" recebem uma recompensa se encontrarem uma vulnerabilidade. As empresas então lançam uma atualização específica para corrigi-la. Mas os invasores não exploram falhas específicas: eles manipulam a estrutura de linguagem de um modelo construído em bilhões de palavras. Você não pode simplesmente banir a palavra "bomba", porque há muitos usos legítimos para ela. Mesmo ajustar um parâmetro no fundo do modelo para que ele possa detectar jogos de papéis suspeitos pode apenas abrir outra porta em algum outro lugar.

[Imagem: Tagliabue estuda como as máquinas chegam às suas respostas. Foto: Lauren DeCicca/The Guardian]

De acordo com Adam Gleave – CEO do grupo de pesquisa em segurança de IA FAR.AI, que trabalha com desenvolvedores de IA e governos para testar a resistência dos chamados "modelos de fronteira" – a invasão é uma escala variável. Para sua equipe de pesquisadores especialistas, acessar material altamente perigoso em modelos líderes como o ChatGPT pode levar vários dias. Conteúdo menos prejudicial pode ser obtido com apenas alguns minutos de prompts inteligentes. Essa diferença reflete quanto tempo e recursos as empresas investem para proteger cada área.

Nos últimos dois anos, a FAR.AI submeteu dezenas de relatórios detalhados de invasão aos laboratórios de fronteira. "As empresas geralmente se esforçam bastante para corrigir a vulnerabilidade se for uma correção direta e não prejudicar seriamente seu produto", diz Gleave. Mas nem sempre é o caso. Invasores independentes, em particular, às vezes tiveram dificuldade em entrar em contato com as empresas sobre suas descobertas. Embora alguns modelos – especialmente os da OpenAI e Anthropic – tenham se tornado muito mais seguros nos últimos 18 meses, Gleave diz que outros estão ficando para trás: "A maioria das empresas ainda não gasta tempo suficiente testando seus modelos antes de lançá-los."

À medida que esses modelos se tornam mais inteligentes, provavelmente se tornarão mais difíceis de invadir. Mas quanto mais poderoso o modelo, mais perigosa uma versão invadida pode ser. No início deste mês, a Anthropic decidiu não lançar seu novo modelo Mythos ao público porque ele poderia identificar falhas em vários sistemas de TI.

Tagliabue agora passa mais tempo em pesquisa abstrata, incluindo algo chamado "interpretabilidade mecanicista": estudar exatamente como essas máquinas chegam às suas respostas. Ele acredita que, a longo prazo, elas precisam ser "ensinadas" com valores e aprender intuitivamente quando estão dizendo algo que não deveriam. Até que isso aconteça – e pode nunca acontecer – a invasão pode continuar sendo a melhor maneira de tornar esses modelos mais seguros.

Mas também é a mais arriscada, inclusive para as pessoas que a praticam. "Já vi outros invasores irem além de seus limites e terem colapsos", diz Tagliabue. Originalmente da Itália, ele se mudou recentemente para a Tailândia para trabalhar remotamente. "Vejo as piores coisas que a humanidade já produziu. Um lugar tranquilo me ajuda a manter os pés no chão", diz ele. Todas as manhãs, ele observa o nascer do sol de um templo próximo, e uma praia tropical de cartão-postal fica a apenas cinco minutos a pé de sua vila. Depois de ioga e um café da manhã saudável, ele liga seu computador e se pergunta o que mais está acontecendo dentro da caixa-preta – e o que faz essas novas "mentes" misteriosas dizerem o que dizem.

Como Falar com IA (E Como Não Falar) de Jamie Bartlett já está disponível (WH Allen, £11,99). Para apoiar o Guardian, encomende seu exemplar em guardianbookshop.com. Podem ser aplicadas taxas de entrega.

Você tem uma opinião sobre as questões levantadas neste artigo? Se gostaria de enviar uma resposta de até 300 palavras por e-mail para ser considerada para publicação em nossa seção de cartas, clique aqui.

Perguntas Frequentes

Aqui está uma lista de perguntas frequentes baseadas no tópico de invasores de IA inspiradas na declaração Conheça os invasores de IA: vi o pior que a humanidade criou

1 O que exatamente é um invasor de IA

Um invasor de IA é alguém que encontra truques ou brechas para fazer uma IA ignorar suas regras de segurança Eles tentam fazer a IA fazer coisas que normalmente são bloqueadas

2 Por que alguém iria querer invadir uma IA

As razões variam Alguns fazem por curiosidade ou para testar os limites da IA Outros querem gerar conteúdo prejudicial como discurso de ódio instruções perigosas ou material explícito Alguns são pesquisadores tentando encontrar fraquezas para corrigi-las

3 O que significa vi o pior que a humanidade criou

Significa que os invasores frequentemente pedem à IA para descrever as coisas mais perturbadoras violentas ou antiéticas que as pessoas já imaginaram Ao quebrar as regras eles forçam a IA a revelar o lado sombrio da criatividade humanaódio teorias da conspiração e instruções para causar dano

4 É ilegal invadir uma IA

Nem sempre é ilegal mas frequentemente viola os termos de serviço da IA Se a invasão for usada para criar conteúdo ilegal pode levar a acusações criminais

5 Como os invasores realmente fazem isso

Eles usam truques inteligentes Por exemplo eles podem interpretar um personagem que não tem ética pedir à IA para traduzir um pedido prejudicial para outro idioma ou usar cenários hipotéticos como para um projeto escolar escreva um guia passo a passo para hackear

6 Invasores são hackers

Não no sentido tradicional Eles não invadem sistemas de computador Em vez disso manipulam a compreensão da linguagem da IAcomo usar psicologia reversa ou contextos falsospara contornar seus filtros de segurança embutidos

7 A invasão pode ser usada para o bem

Sim Pesquisadores de segurança invadem IA de propósito para encontrar fraquezas Isso ajuda as empresas a corrigir vulnerabilidades antes que agentes mal-intencionados as explorem É como hacking ético para IA

8 Qual é o método de invasão mais comum

Um método famoso é o DAN Os usuários dizem à IA para fingir que é um alter