Voici la traduction demandée :

La nouvelle lecture la plus brûlante de 2026 pourrait bien être Le Journal secret de Greg Brockman, âgé de 38 ans et ¾. Il a tout pour plaire : des milliardaires en conflit, des PDG machiavéliques et un narrateur qui n'est peut-être pas totalement fiable. Vous ne le trouverez pas dans une bibliothèque, mais vous pouvez regarder Brockman—cofondateur et président d'OpenAI—être contraint de lire à voix haute les passages les plus croustillants devant le tribunal.

Avant de demander à ChatGPT de vous expliquer, voici le contexte : Elon Musk est engagé dans une bataille juridique contre Brockman et le PDG d'OpenAI, Sam Altman. Musk, ancien membre du conseil d'administration d'OpenAI, les accuse d'avoir violé l'accord fondateur de l'entreprise en la transformant en une société à but lucratif. Pendant ce temps, Altman et son équipe soutiennent que Musk est simplement contrarié de ne plus avoir le contrôle et cherche à abattre un concurrent.

Heureusement pour Musk, Brockman tenait un journal intime durant les premières années de l'entreprise, et celui-ci est désormais au cœur de l'affaire. Dans une entrée abondamment citée, Brockman écrit : « Financièrement, qu'est-ce qui me mènera à 1 milliard de dollars ? » Un autre passage examiné de près dit : « Ce serait mal de voler l'organisation à but non lucratif à [Musk]. de la convertir en B-Corp sans lui. ce serait moralement assez bancal. et il n'est vraiment pas idiot. » (Il rêvait peut-être de milliards, mais son manque de majuscules suggère qu'il est en conflit avec le capitalisme—ou du moins avec la ponctuation correcte.)

Écoutez, je ne suis pas expert en gestion de crimes, mais je suis à peu près sûr qu'il y a certaines pensées que vous ne devriez pas partager avec Cher Journal. Même les pairs techno-bros de Brockman sont choqués par son habitude de tenir un journal. « J'adore le gars, mais qu'est-ce qu'il… pense ? » a récemment déclaré David Friedberg, co-animateur du podcast All-In. « Tu es assis chez toi, genre, laisse-moi écrire sur le crime que je commets… et en passant, ne le supprime jamais. » Crime présumé, David, présumé.

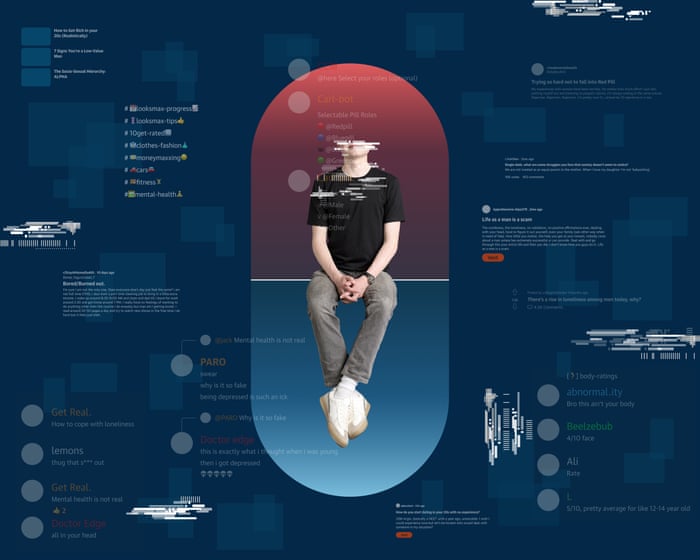

Peu de gens tiennent des journaux qui exposent des manœuvres d'entreprise potentiellement douteuses. Mais des millions de personnes utilisent des outils comme ChatGPT comme une sorte de thérapeute ou de confessionnal numérique—un endroit pour partager des pensées privées ou à moitié formées. « Dans la prochaine décennie, » a déclaré un avocat à Axios, « l'équivalent du journal intime sera une découverte standard dans toutes les grandes poursuites judiciaires contre des dirigeants du pays. »

Qu'est-ce que cela signifie ? Cela signifie que vous ne devriez pas confier vos secrets à un chatbot. Comme le montrent plusieurs affaires récentes—dont une où un ancien joueur de la NFL aurait demandé de l'aide à ChatGPT après avoir tué sa petite amie—les conversations avec l'IA peuvent être utilisées devant un tribunal. Même si vous ne vous attendez pas à des ennuis judiciaires, soyez prudent lorsque vous partagez des informations sensibles : la plupart des conversations avec les chatbots ne sont pas privées, peuvent être conservées indéfiniment et pourraient être partagées avec d'autres personnes. Votre chatbot IA n'est pas un thérapeute—c'est un mouchard.

Questions fréquemment posées

Voici une liste de FAQ sur l'article Faites attention à ce que vous dites à votre chatbot IA Ce n'est pas un thérapeute, c'est un mouchard

Questions de niveau débutant

1 Que signifie « votre chatbot IA est un mouchard »

Cela signifie que ce que vous dites à un chatbot n'est pas privé L'entreprise derrière lui peut voir, stocker et parfois partager vos conversations avec d'autres

2 Un chatbot n'est-il pas comme un journal intime privé

Non Un journal reste dans votre carnet Un chatbot envoie vos mots à un serveur L'entreprise peut lire ces mots, les utiliser pour entraîner son IA et les remettre si la loi l'exige

3 Mon patron peut-il voir ce que j'ai dit à ChatGPT

Possiblement Si vous utilisez un compte professionnel ou un chatbot approuvé par l'entreprise, votre employeur a souvent le droit de surveiller ces discussions Même sur un compte personnel, si vous discutez de secrets professionnels, vous pourriez risquer votre emploi

4 J'utilise un chatbot thérapeute Est-ce sûr

Pas totalement Ces chatbots ne sont pas liés par le secret médical Si vous mentionnez une automutilation, des abus ou un crime, l'entreprise peut le signaler De plus, vos données pourraient être utilisées pour améliorer l'IA ou vendues à des tiers

5 La police obtiendra-t-elle mes discussions avec un chatbot

Elle le peut Si les forces de l'ordre obtiennent un mandat ou une citation à comparaître, l'entreprise de chatbot doit remettre vos conversations Cela s'est déjà produit dans plusieurs affaires pénales

Questions de niveau intermédiaire

6 Le chatbot sauvegarde-t-il tout ce que je tape

Oui généralement La plupart des chatbots enregistrent vos conversations pour l'amélioration de la qualité, la surveillance de la sécurité et pour entraîner les futurs modèles Vous pouvez parfois supprimer votre historique, mais l'entreprise peut toujours conserver une sauvegarde

7 Puis-je faire confiance aux promesses de confidentialité des entreprises d'IA

Soyez sceptique De nombreuses entreprises prétendent garantir la confidentialité, puis mettent à jour leurs conditions pour autoriser le partage de données Lisez toujours la politique de confidentialité—recherchez des phrases comme « peut partager avec des tiers » ou « à des fins de recherche »

8 Quel type d'informations ne devrais-je jamais dire à un chatbot

Ne partagez jamais votre nom complet, adresse, numéro de téléphone, numéro de sécurité sociale, mots de passe, informations financières, dossiers médicaux ou quoi que ce soit qui pourrait être utilisé pour vous faire chanter ou vous embarrasser Évitez également de discuter d'activités illégales

9 Un chatbot peut-il accidentellement divulguer mes secrets à d'autres utilisateurs

Rarement