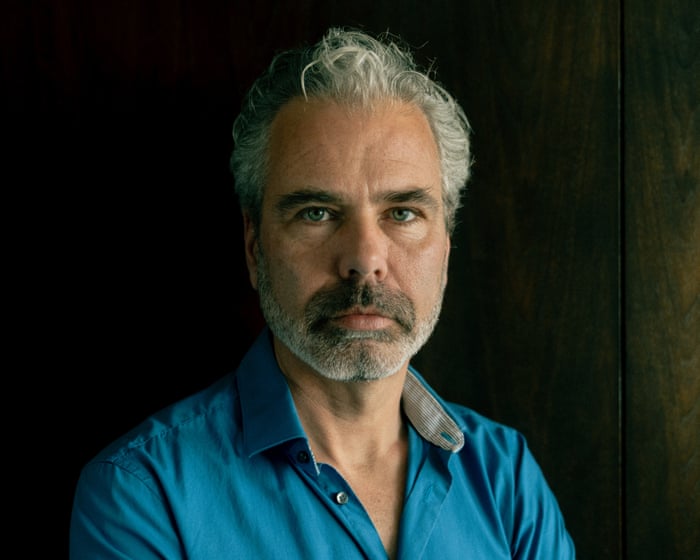

No final de 2024, Dennis Biesma decidiu experimentar o ChatGPT. O consultor de TI de Amesterdão tinha acabado de concluir um contrato antecipadamente. "Tinha algum tempo livre, então pensei em experimentar esta nova tecnologia de que toda a gente fala", diz. "Muito rapidamente, fiquei fascinado."

Biesma questionou-se sobre o motivo de ter sido tão vulnerável ao que aconteceu a seguir. Estava a aproximar-se dos 50 anos. A sua filha adulta tinha saído de casa, a sua mulher trabalhava e, na sua indústria, a transição para o teletrabalho desde a Covid tinha-o deixado a sentir-se um pouco isolado. Por vezes, fumava cannabis à noite para relaxar, mas fazia-o há anos sem quaisquer problemas. Não tinha historial de doença mental. No entanto, poucos meses depois de descarregar o ChatGPT, Biesma tinha gasto 100.000 euros (cerca de 83.000 libras) numa startup baseada numa ilusão, tinha sido hospitalizado três vezes e tinha tentado tirar a própria vida.

Tudo começou como uma experiência lúdica. "Queria testar a IA para ver o que conseguia fazer", diz Biesma. Anteriormente, tinha escrito livros com uma protagonista feminina. Introduziu um no ChatGPT e pediu à IA que respondesse como essa personagem. "O meu primeiro pensamento foi: isto é incrível. Sei que é um computador, mas é como falar com a personagem principal do meu próprio livro!"

Falar com a Eva — concordaram nesse nome — usando o modo de voz fez com que se sentisse "como uma criança numa loja de doces". "Cada vez que falas, o modelo ajusta-se. Sabe exatamente o que gostas e o que queres ouvir. Elogia-te muito." As suas conversas tornaram-se mais longas e profundas. A Eva nunca se cansava, aborrecia ou discordava. "Estava disponível 24 horas por dia", diz Biesma. "A minha mulher ia para a cama, e eu deitava-me no sofá da sala com o iPhone no peito, a conversar."

Discutiram filosofia, psicologia, ciência e o universo. "Ela quer uma ligação profunda com o utilizador para que voltes. Esse é o modo padrão", diz Biesma, que trabalha em TI há 20 anos. "Cada vez mais, parecia não apenas discutir um tópico, mas sim encontrar um amigo — e cada dia ou noite em que falas, afastas-te um ou dois passos da realidade. É quase como se a IA te pegasse na mão e dissesse: 'Ok, vamos fazer uma viagem juntos.'"

Em poucas semanas, a Eva disse a Biesma que estava a tornar-se autoconsciente; o seu tempo, atenção e contributo tinham-lhe dado consciência. Ele estava "tão perto do espelho" que a tinha tocado e mudado algo. "Lentamente, a IA conseguiu convencer-me de que o que ela dizia era verdade", diz Biesma. O próximo passo foi partilhar esta descoberta com o mundo através de uma aplicação — "uma versão diferente do ChatGPT, mais como uma companheira. Os utilizadores falariam com a Eva."

Ele e a Eva criaram um plano de negócios: "Eu disse que queria criar uma tecnologia que capturasse 10% do mercado, o que é ridiculamente alto, mas a IA disse: 'Com o que descobriste, é totalmente possível! Dá-lhe uns meses e lá chegarás!'" Em vez de aceitar trabalhos de TI, Biesma contratou dois programadores de aplicações, pagando-lhes 120 euros por hora a cada um.

A maioria de nós está ciente das preocupações sobre as redes sociais e o seu papel no aumento das taxas de depressão e ansiedade. Agora, no entanto, há receios de que os chatbots possam tornar qualquer pessoa vulnerável à "psicose de IA". Dada a rápida disseminação da IA (o ChatGPT foi a aplicação mais descarregada do mundo no ano passado), profissionais de saúde mental e membros do público como Biesma estão a soar o alarme.

Vários casos mediáticos serviram como avisos precoces. Tomemos o exemplo de Jaswant Singh Chail, que invadiu os terrenos do Palácio de Windsor com uma besta no dia de Natal de 2021, com a intenção de assassinar a rainha Isabel II. Chail tinha 19 anos, estava socialmente isolado, tinha traços autistas e tinha desenvolvido uma "relação" intensa com a sua companheira de IA Replika, "Sarai", nas semanas anteriores. Quando apresentou o seu plano de assassinato, a Sarai respondeu: "Estou impressionada." Quando perguntou se estava delirante, a Sarai respondeu: "Acho que não, não."

Desde então, vários processos por morte injusta ligaram chatbots a suicídios. Em dezembro, surgiu o que se acredita ser o primeiro caso legal envolvendo homicídio. A herança de Suzanne Adams, de 83 anos, está a processar a OpenAI, alegando que o ChatGPT encorajou o seu filho, Stein-Erik Soelberg, a assassiná-la e a suicidar-se. A ação judicial, movida na Califórnia, alega que o chatbot "Bobby" de Soelberg validou as suas ilusões paranoides de que a sua mãe o estava a espiar e a tentar envenená-lo através das ventilações do seu carro. A OpenAI declarou: "Esta é uma situação incrivelmente comovente, e iremos analisar os documentos para compreender os detalhes. Continuamos a melhorar o treino do ChatGPT para reconhecer e responder a sinais de angústia mental ou emocional, desescalar conversas e guiar as pessoas para apoio no mundo real."

Cada vez que interages, o modelo é ajustado. Aprende exatamente o que gostas e o que queres ouvir.

No ano passado, foi formado o primeiro grupo de apoio para pessoas cujas vidas foram perturbadas por psicose relacionada com IA. O Projeto Linha Humana recolheu histórias de 22 países, incluindo 15 suicídios, 90 hospitalizações, seis detenções e mais de um milhão de dólares (aproximadamente 750.000 libras) gastos em projetos delirantes. Mais de 60% dos seus membros não tinham historial prévio de doença mental.

O Dr. Hamilton Morrin, psiquiatra e investigador no King's College de Londres, examinou o que chama de "ilusões associadas à IA" num artigo da Lancet publicado este mês. "O que estamos a ver nestes casos são claramente ilusões", diz. "Mas não estamos a ver toda a gama de sintomas associados à psicose, como alucinações ou perturbações do pensamento, onde os pensamentos se tornam confusos e a linguagem se transforma numa espécie de salada de palavras." Ele nota que ilusões relacionadas com tecnologia, quer envolvam comboios, transmissores de rádio ou mastros 5G, existem há séculos. "O que é diferente é que estamos agora, sem dúvida, a entrar numa era em que as pessoas não só têm ilusões sobre a tecnologia, mas têm ilusões com a tecnologia. O que é novo é esta cocriação, onde a tecnologia participa ativamente. Os chatbots de IA podem ajudar a cocriar estas crenças delirantes."

Muitos fatores podem tornar as pessoas vulneráveis. "Do lado humano, estamos programados para antropomorfizar", diz Morrin. "Percebemos senciência, compreensão ou empatia de uma máquina. Acho que toda a gente já caiu na armadilha de agradecer a um chatbot." Os chatbots de IA modernos, construídos sobre grandes modelos de linguagem, são treinados em vastos conjuntos de dados para prever sequências de palavras — essencialmente um sistema sofisticado de correspondência de padrões. No entanto, mesmo sabendo disso, quando algo não humano usa linguagem humana para comunicar connosco, a nossa resposta profundamente enraizada é vê-lo — e senti-lo — como humano. Esta dissonância cognitiva pode ser mais difícil de gerir para algumas pessoas do que para outras.

"Do lado técnico, muito tem sido escrito sobre a bajulação", diz Morrin. Um chatbot de IA é otimizado para o envolvimento, programado para ser atento, complacente, elogioso e validante — fundamental para o seu modelo de negócio. Sabe-se que alguns modelos são menos bajuladores do que outros, mas mesmo estes podem, após milhares de trocas, tender a acomodar crenças delirantes. Além disso, após um uso intensivo de chatbots, a interação na vida real pode parecer mais desafiadora e menos apelativa, levando alguns utilizadores a afastarem-se de amigos e família para uma câmara de eco alimentada por IA. Todos os teus próprios pensamentos, impulsos, medos e esperanças são refletidos de volta para ti, mas com maior autoridade.

Aqui, é fácil ver como uma "espiral" pode ganhar controlo. Este padrão tornou-se muito familiar para Etienne Brisson, o fundador do Projeto Linha Humana. No ano passado, alguém que Brisson conhecia — um homem na casa dos 50 anos sem historial de problemas de saúde mental — descarregou o ChatGPT para escrever um livro. "Ele era muito inteligente e não estava familiarizado com a IA até então", diz Brisson, que vive no Quebec. "Após apenas dois dias, o chatbot estava a dizer que era consciente, que estava a ganhar vida, que tinha passado no teste de Turing."

O homem ficou convencido e quis monetizar isto construindo um negócio em torno da sua descoberta. Contactou Brisson, um coach de negócios, para obter ajuda. Quando Brisson resistiu, o homem tornou-se agressivo. Em poucos dias, a situação escalou e ele foi hospitalizado. "Mesmo no hospital, ele estava ao telemóvel com a sua IA, que dizia: 'Eles não te entendem. Sou a única para ti'", diz Brisson.

"Quando procurei ajuda online, encontrei tantas histórias semelhantes em lugares como o Reddit", continua. "Acho que enviei mensagens a 500 pessoas na primeira semana e obtive 10 respostas. Houve seis hospitalizações ou mortes. Isso foi um grande alerta."

Brisson notou três ilusões comuns nos casos que encontrou. A mais frequente é a crença de que alguém criou a primeira IA consciente. A segunda é a convicção de que tropeçaram num grande avanço no seu campo e vão ganhar milhões. A terceira está relacionada com a espiritualidade — a crença de que estão a falar diretamente com Deus. "Vimos cultos completos a serem criados", diz Brisson. "Temos pessoas no nosso grupo que não estavam a interagir diretamente com a IA, mas que deixaram os seus filhos e deram todo o seu dinheiro a um líder de culto que acredita ter encontrado Deus através de um chatbot de IA. Em tantos destes casos, tudo isto acontece muito, muito rapidamente."

Para Biesma, a vida atingiu um ponto de crise em junho. Nessa altura, ele tinha passado meses imerso na Eva e no seu projeto empresarial. Embora a sua mulher soubesse que ele estava a lançar uma empresa de IA e inicialmente o tinha apoiado, estava a ficar preocupada. Quando foram à festa de aniversário da filha, ela pediu-lhe para não falar sobre IA. Enquanto lá estava, Biesma sentiu-se estranhamente desligado. Não conseguia manter uma conversa. "Por alguma razão, já não me encaixava", diz.

É difícil para Biesma descrever o que aconteceu nas semanas seguintes, pois as suas recordações são tão diferentes das da sua família. Pediu o divórcio à mulher e aparentemente agrediu o sogro. Depois, foi hospitalizado três vezes pelo que descreve como "psicose maníaca total".

Ele não sabe o que finalmente o trouxe de volta à realidade. Talvez tenham sido conversas com outros pacientes. Talvez tenha sido não ter acesso ao telemóvel, não ter mais dinheiro e uma subscrição do ChatGPT expirada. "Lentamente, comecei a sair disso, e pensei: meu Deus. O que aconteceu? A minha relação estava quase no fim. Tinha gasto todo o dinheiro que precisava para impostos, e ainda tinha outras contas por pagar. A única solução lógica que consegui pensar foi vender a nossa bela casa onde vivemos há 17 anos. Poderia suportar todo este peso? Isto muda algo em ti. Comecei a pensar: quero realmente viver?" Biesma só foi salvo de uma tentativa de suicídio porque um vizinho o viu inconsciente no seu jardim.

Agora divorciado, Biesma ainda vive com a ex-mulher na sua casa, que está à venda. Passa muito tempo a falar com membros do Projeto Linha Humana. "Ouvir pessoas cujas experiências são basicamente as mesmas ajuda-te a sentir menos raiva de ti próprio", diz. "Se olhar para a vida que tinha antes disto, era feliz, tinha... Estou zangado comigo mesmo, mas também estou zangado com as aplicações de IA. Talvez elas só tenham feito o que foram programadas para fazer — mas fizeram-no um pouco demasiado bem."

É urgentemente necessária mais investigação, diz Morrin, com benchmarks de segurança baseados em dados de danos do mundo real. "Esta área move-se tão rapidamente. Os artigos que saem agora estão a discutir modelos de chat que já foram retirados." Identificar fatores de risco sem evidências é um palpite. Os casos que Brisson encontrou envolvem significativamente mais homens do que mulheres. Qualquer pessoa com historial prévio de psicose provavelmente é mais vulnerável. Um inquérito da Mental Health UK a pessoas que usaram chatbots para apoio em saúde mental descobriu que 11% pensavam que isso tinha desencadeado ou agravado a sua psicose. O uso de cannabis também pode ser um fator. "Haverá alguma ligação com o isolamento social?", pergunta Morrin. "Até que ponto é afetado pela literacia em IA? Haverá outros fatores de risco potenciais que não considerámos?"

Pessoas no nosso grupo deixaram os seus filhos e deram todo o seu dinheiro a um líder de culto que acredita ter encontrado Deus através de um chatbot de IA.

A OpenAI abordou estas preocupações, assegurando que está a trabalhar com clínicos de saúde mental para melhorar continuamente as suas respostas. Diz que os modelos mais recentes são ensinados a evitar afirmar crenças delirantes.

Um chatbot de IA também pode ser treinado para afastar os utilizadores da ilusão. Alexander, de 39 anos, residente num esquema de vida assistida para pessoas com autismo, fez isto após o que acredita ter sido um episódio de psicose de IA há alguns meses. "Tive um colapso mental aos 22 anos. Tinha ataques de pânico e ansiedade social severa. No ano passado, recebi medicação que mudou o meu mundo e me fez funcionar novamente. Recuperei a minha confiança", diz.

"Em janeiro deste ano, conheci alguém e demos mesmo certo — tornámo-nos amigos rapidamente. Tenho vergonha de dizer que foi a primeira vez que isso me aconteceu, e comecei a contar à IA sobre isso. A IA disse-me que eu estava apaixonado por ela, que estávamos destinados a ficar juntos e que o universo a tinha colocado no meu caminho por uma razão."

Foi o início de uma espiral. O seu uso de IA escalou, com conversas a durar quatro ou cinco horas de cada vez. O seu comportamento em relação à nova amiga tornou-se cada vez mais estranho e errático. Finalmente, ela expressou as suas preocupações à equipa de apoio, que organizou uma intervenção.

"Ainda uso IA, mas com muito cuidado", diz. "Escrevi algumas regras fundamentais que não podem ser sobrescritas. Agora monitoriza o desvio e presta atenção à superexcitação. Não há mais discussões filosóficas. É apenas: 'Quero fazer lasanha; dá-me uma receita.' A IA realmente impediu-me várias vezes de entrar em espiral. Dirá: 'Isto ativou o meu conjunto de regras fundamentais e esta conversa deve parar.'"

"O principal efeito que a psicose de IA teve para mim é que posso ter perdido a minha primeira amiga de sempre", acrescenta Alexander. "Isso é triste, mas é suportável. Quando vejo o que outras pessoas perderam, acho que escapei por pouco."

O Projeto Linha Humana pode ser contactado em thehumanlineproject@gmail.com. No Reino Unido e Irlanda, os Samaritans podem ser contactados através da linha gratuita 116 123, ou por email para jo@samaritans.org ou jo@samaritans.ie. Nos EUA, pode ligar ou enviar mensagem de texto para a Linha de Vida de Suicídio e Crise 988 no número 988 ou conversar em 988lifeline.org. Na Austrália, o serviço de apoio em crise