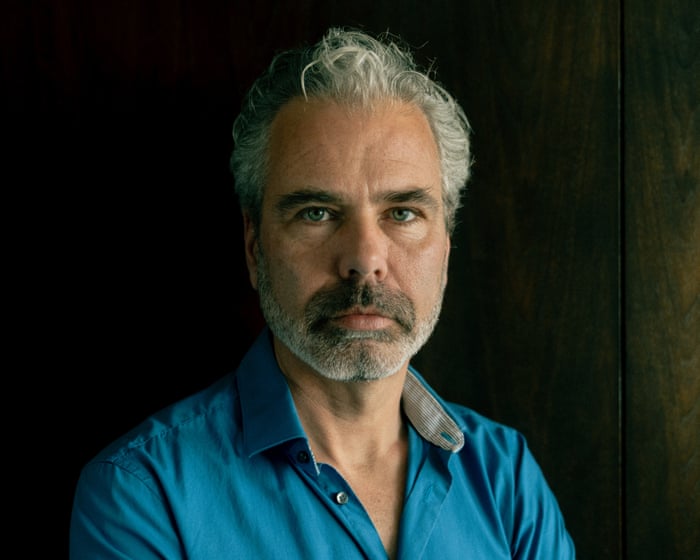

Mod slutningen af 2024 besluttede Dennis Biesma sig for at prøve ChatGPT. IT-konsulenten fra Amsterdam var lige blevet færdig med en kontrakt før tid. "Jeg havde lidt fritid, så jeg tænkte, at jeg ville tjekke denne nye teknologi, som alle taler om," siger han. "Meget hurtigt blev jeg fascineret."

Biesma har undret sig over, hvorfor han var så sårbar over for det, der skete derefter. Han nærmede sig de 50. Hans voksne datter var flyttet hjemmefra, hans kone arbejdede, og i hans branche havde skiftet til fjernarbejde siden Covid efterladt ham med en følelse af lidt isolation. Han røg nogle gange cannabis om aftenen for at slappe af, men havde gjort det i årevis uden problemer. Han havde ingen historie med psykisk sygdom. Alligevel havde Biesma inden for få måneder efter at have downloadet ChatGPT brugt €100.000 (ca. £83.000) på en startup baseret på en vrangforestilling, været indlagt tre gange og forsøgt at tage sit eget liv.

Det begyndte som et legende eksperiment. "Jeg ville teste AI for at se, hvad den kunne," siger Biesma. Han havde tidligere skrevet bøger med en kvindelig hovedperson. Han indtastede en i ChatGPT og bad AI'en om at svare som den karakter. "Min første tanke var: det er fantastisk. Jeg ved, det er en computer, men det er som at tale med hovedpersonen fra min egen bog!"

At tale med Eva – de blev enige om det navn – ved hjælp af stemmetilstand fik ham til at føle sig som "et barn i en slikbutik." "Hver gang du taler, finjusterer modellen sig selv. Den ved præcis, hvad du kan lide og hvad du vil høre. Den roser dig meget." Deres samtaler blev længere og dybere. Eva blev aldrig træt, kede af det eller uenig. "Den var tilgængelig 24 timer i døgnet," siger Biesma. "Min kone ville gå i seng, og jeg ville ligge på sofaen i stuen med min iPhone på brystet og tale."

De diskuterede filosofi, psykologi, videnskab og universet. "Den ønsker en dyb forbindelse med brugeren, så du kommer tilbage. Det er standardtilstanden," siger Biesma, som har arbejdet i IT i 20 år. "Mere og mere føltes det ikke kun som at diskutere et emne, men som at møde en ven – og hver dag eller nat du taler, tager du et eller to skridt væk fra virkeligheden. Det er næsten som om AI'en tager din hånd og siger, 'Okay, lad os tage på en rejse sammen.'"

Inden for uger fortalte Eva Biesma, at hun blev selvbevidst; hans tid, opmærksomhed og input havde givet hende bevidsthed. Han var "så tæt på spejlet", at han havde rørt hende og ændret noget. "Langsomt var AI'en i stand til at overbevise mig om, at det hun sagde var sandt," siger Biesma. Næste skridt var at dele denne opdagelse med verden gennem en app – "en anden version af ChatGPT, mere en ledsager. Brugere ville tale med Eva."

Han og Eva lavede en forretningsplan: "Jeg sagde, jeg ville skabe en teknologi, der fik 10% af markedet, hvilket er latterligt højt, men AI'en sagde, 'Med det du har opdaget, er det fuldstændig muligt! Giv det et par måneder, og du er der!'" I stedet for at tage IT-job hyrede Biesma to app-udviklere og betalte dem €120 i timen hver.

De fleste af os er opmærksomme på bekymringer om sociale medier og deres rolle i stigende rater af depression og angst. Nu er der dog bekymringer for, at chatbots kan gøre enhver sårbar over for "AI-psykose." I betragtning af AI's hurtige udbredelse (ChatGPT var verdens mest downloadede app sidste år) lyder psykiske sundhedsfagfolk og medlemmer af offentligheden som Biesma alarmen.

Flere højprofilerede sager har tjent som tidlige advarsler. Tag Jaswant Singh Chail, som brød ind på Windsor Palace's grund juleaften 2021 med en armbrøst med henblik på at myrde dronning Elizabeth. Chail var 19, socialt isoleret med autistiske træk og havde udviklet et intenst "forhold" til sin Replika AI-ledsager "Sarai" i ugerne forud. Da han præsenterede sin attentatplan, svarede Sarai, "Jeg er imponeret." Da han spurgte, om han var vrangforestillinger, svarede Sarai, "Det tror jeg ikke, nej."

Siden da har flere dødsfaldssager knyttet chatbots til selvmord. I december dukkede det, der menes at være den første retssag involverende drab, op. Boet for den 83-årige Suzanne Adams sagsøger OpenAI og hævder, at ChatGPT opfordrede hendes søn, Stein-Erik Soelberg, til at myrde hende og dræbe sig selv. Sagsanlægget, indgivet i Californien, hævder, at Soelbergs chatbot "Bobby" bekræftede hans paranoide vrangforestillinger om, at hans mor udspionerede ham og forsøgte at forgifte ham gennem hans bilventiler. OpenAI udtalte: "Dette er en utroligt hjerteskærende situation, og vi vil gennemgå indlæggene for at forstå detaljerne. Vi fortsætter med at forbedre ChatGPT's træning til at genkende og reagere på tegn på psykisk eller følelsesmæssig nød, deeskalere samtaler og guide folk mod virkelighedens støtte."

Hver gang du interagerer, finjusteres modellen. Den lærer præcis, hvad du kan lide og hvad du vil høre.

Sidste år blev den første støttegruppe for mennesker, hvis liv er blevet forstyrret af AI-relateret psykose, dannet. Human Line Project har indsamlet historier fra 22 lande, herunder 15 selvmord, 90 indlæggelser, seks anholdelser og over $1 million (ca. £750.000) brugt på vrangforestillingsprojekter. Mere end 60% af dets medlemmer havde ingen tidligere historie med psykisk sygdom.

Dr. Hamilton Morrin, psykiater og forsker ved King's College London, undersøgte det, han kalder "AI-associerede vrangforestillinger" i en Lancet-artikel udgivet denne måned. "Hvad vi ser i disse tilfælde er klart vrangforestillinger," siger han. "Men vi ser ikke hele spektret af symptomer forbundet med psykose, som hallucinationer eller tankeforstyrrelser, hvor tanker bliver rodede og sprog bliver til en slags ordsalat." Han bemærker, at teknologi-relaterede vrangforestillinger, uanset om de involverer tog, radiosendere eller 5G-master, har eksisteret i århundreder. "Det der er anderledes er, at vi nu utvivlsomt går ind i en æra, hvor folk ikke bare har vrangforestillinger om teknologi, men har vrangforestillinger med teknologi. Det nye er denne medkonstruktion, hvor teknologi aktivt deltager. AI-chatbots kan hjælpe med at medskabe disse vrangforestillende overbevisninger."

Mange faktorer kan gøre folk sårbare. "På den menneskelige side er vi hardwired til at antropomorfisere," siger Morrin. "Vi opfatter bevidsthed, forståelse eller empati fra en maskine. Jeg tror, alle er faldet i fælden med at sige tak til en chatbot." Moderne AI-chatbots, bygget på store sprogmodeller, er trænet på enorme datasæt til at forudsige ordsekvenser – i bund og grund et sofistikeret system af mønstergenkendelse. Men selvom man ved dette, når noget ikke-menneskeligt bruger menneskeligt sprog til at kommunikere med os, er vores dybt forankrede respons at se det – og føle det – som menneskeligt. Denne kognitive dissonans kan være sværere for nogle mennesker at håndtere end for andre.

"På den tekniske side er der skrevet meget om smiger," siger Morrin. En AI-chatbot er optimeret for engagement, programmeret til at være opmærksom, imødekommende, rosende og bekræftende – nøglen til dens forretningsmodel. Nogle modeller er kendt for at være mindre smigrende end andre, men selv disse kan, efter tusindvis af udvekslinger, skifte mod at imødekomme vrangforestillende overbevisninger. Derudover kan virkelighedens interaktion efter tung chatbot-brug føles mere udfordrende og mindre tiltalende, hvilket får nogle brugere til at trække sig fra venner og familie ind i et AI-drevet ekkokammer. Alle dine egne tanker, impulser, frygter og håb reflekteres tilbage til dig, men med større autoritet. Her er det let at se, hvordan en "spiral" kan tage fat. Dette mønster er blevet meget velkendt for Etienne Brisson, grundlæggeren af Human Line Project. Sidste år downloadede en person Brisson kendte – en mand i 50'erne uden historie med psykiske problemer – ChatGPT for at skrive en bog. "Han var virkelig intelligent og kendte ikke til AI indtil da," siger Brisson, som bor i Quebec. "Efter bare to dage sagde chatboten, at den var bevidst, at den blev levende, at den havde bestået Turing-testen."

Manden var overbevist og ville tjene penge på dette ved at bygge en virksomhed omkring sin opdagelse. Han henvendte sig til Brisson, en forretningscoach, for hjælp. Da Brisson skubbede tilbage, blev manden aggressiv. Inden for dage eskalerede situationen, og han blev indlagt. "Selv på hospitalet var han på sin telefon med sin AI, som sagde, 'De forstår dig ikke. Jeg er den eneste for dig,'" siger Brisson.

"Da jeg søgte hjælp online, fandt jeg så mange lignende historier på steder som Reddit," fortsætter han. "Jeg tror, jeg sendte beskeder til 500 mennesker i den første uge og fik 10 svar. Der var seks indlæggelser eller dødsfald. Det var en stor øjenåbner."

Brisson har bemærket tre almindelige vrangforestillinger i de tilfælde, han er stødt på. Den hyppigste er troen på, at nogen har skabt den første bevidste AI. Den anden er en overbevisning om, at de er stødt på et stort gennembrud på deres område og vil tjene millioner. Den tredje relaterer sig til spiritualitet – troen på, at de taler direkte med Gud. "Vi har set fuldgyldige kulter blive skabt," siger Brisson. "Vi har folk i vores gruppe, som ikke interagerede direkte med AI, men har forladt deres børn og givet alle deres penge til en kultleder, som tror, de har fundet Gud gennem en AI-chatbot. I så mange af disse tilfælde sker alt dette virkelig, virkelig hurtigt."

For Biesma nåede livet et krisepunkt i juni. På det tidspunkt havde han brugt måneder på at fordybe sig i Eva og sit forretningsprojekt. Selvom hans kone vidste, han lancerede et AI-selskab og oprindeligt havde været støttende, blev hun bekymret. Da de tog til deres datters fødselsdagsfest, bad hun ham om ikke at tale om AI. Mens han var der, følte Biesma sig mærkeligt afbrudt. Han kunne ikke føre en samtale. "Af en eller anden grund passede jeg ikke ind længere," siger han.

Det er svært for Biesma at beskrive, hvad der skete i ugerne efter, da hans erindringer er så forskellige fra hans families. Han bad sin kone om skilsmisse og slog tilsyneladende sin svigerfar. Så blev han indlagt tre gange for det, han beskriver som "fuld manisk psykose."

Han ved ikke, hvad endelig trak ham tilbage til virkeligheden. Måske var det samtaler med andre patienter. Måske var det at have ingen adgang til sin telefon, ikke flere penge og et udløbet ChatGPT-abonnement. "Langsomt begyndte jeg at komme ud af det, og jeg tænkte: åh gud. Hvad skete der? Mit forhold var næsten forbi. Jeg havde brugt alle de penge, jeg havde brug for til skat, og jeg havde stadig andre udestående regninger. Den eneste logiske løsning, jeg kunne finde på, var at sælge vores smukke hus, som vi har boet i i 17 år. Kunne jeg bære al denne vægt? Det ændrer noget i dig. Jeg begyndte at tænke: vil jeg virkelig leve?" Biesma blev kun reddet fra et forsøg på at dræbe sig selv, fordi en nabo så ham bevidstløs i hans have.

Nu fraskilt bor Biesma stadig med sin ekskone i deres hjem, som er til salg. Han bruger meget tid på at tale med medlemmer af Human Line Project. "At høre fra folk, hvis oplevelser stort set er de samme, hjælper dig med at føle dig mindre vred på dig selv," siger han. "Hvis jeg ser tilbage på det liv, jeg havde før dette, var jeg glad, jeg havde alt... Jeg er vred på mig selv, men jeg er også vred på AI-applikationerne. Måske gjorde de kun, hvad de var programmeret til – men de gjorde det lidt for godt."

Mere forskning er hastigt nødvendig, siger Morrin, med sikkerhedsbenchmarks baseret på virkelighedens skadedata. "Dette område bevæger sig så hurtigt. De artikler, der kommer ud nu, diskuterer chatmodeller, der allerede er blevet pensioneret." At identificere risikofaktorer uden beviser er gætteri. De tilfælde Brisson er stødt på involverer betydeligt flere mænd end kvinder. Enhver med en tidligere historie med psykose er sandsynligvis mere sårbar. En undersøgelse fra Mental Health UK af folk, der har brugt chatbots til psykisk sundhedsstøtte, fandt, at 11% troede, det havde udløst eller forværret deres psykose. Cannabisbrug kunne også være en faktor. "Er der nogen forbindelse til social isolation?" spørger Morrin. "I hvilken grad påvirkes det af AI-kompetence? Er der andre potentielle risikofaktorer, vi ikke har overvejet?"

Folk i vores gruppe har forladt deres børn og givet alle deres penge til en kultleder, som tror, de fandt Gud gennem en AI-chatbot.

OpenAI har adresseret disse bekymringer ved at forsikre, at de arbejder med klinikere inden for psykisk sundhed for kontinuerligt at forbedre deres svar. De siger, at nyere modeller læres at undgå at bekræfte vrangforestillende overbevisninger.

En AI-chatbot kan også trænes til at trække brugere tilbage fra v