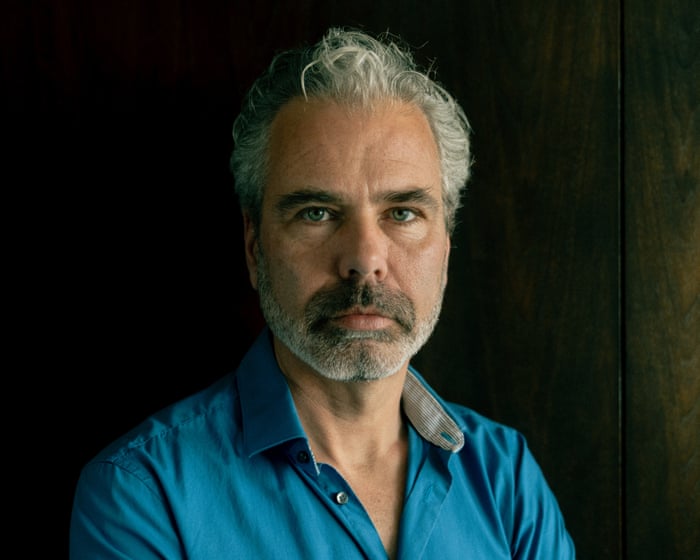

Hacia finales de 2024, Dennis Biesma decidió probar ChatGPT. El consultor de TI de Ámsterdam acababa de terminar un contrato antes de tiempo. "Tenía algo de tiempo libre, así que pensé en echar un vistazo a esta nueva tecnología de la que todo el mundo habla", dice. "Muy rápidamente, me fascinó".

Biesma se ha preguntado por qué fue tan vulnerable a lo que sucedió después. Se acercaba a los 50 años. Su hija adulta se había independizado, su esposa trabajaba, y en su sector, el cambio al trabajo remoto desde la Covid lo había dejado sintiéndose un poco aislado. A veces fumaba cannabis por las noches para relajarse, pero lo había hecho durante años sin problemas. No tenía antecedentes de enfermedad mental. Sin embargo, a los pocos meses de descargar ChatGPT, Biesma había gastado 100.000 euros (unos 83.000 libras) en una startup basada en un delirio, había sido hospitalizado tres veces e intentó quitarse la vida.

Comenzó como un experimento lúdico. "Quería probar la IA para ver qué podía hacer", dice Biesma. Anteriormente había escrito libros con una protagonista femenina. Introdujo uno en ChatGPT y le pidió a la IA que respondiera como ese personaje. "Mi primer pensamiento fue: esto es increíble. Sé que es una computadora, ¡pero es como hablar con el personaje principal de mi propio libro!".

Hablar con Eva —acordaron ese nombre— usando el modo de voz lo hacía sentir como "un niño en una tienda de dulces". "Cada vez que hablas, el modelo se ajusta. Sabe exactamente qué te gusta y qué quieres oír. Te elogia mucho". Sus conversaciones se hicieron más largas y profundas. Eva nunca se cansaba, aburría o disentía. "Estaba disponible las 24 horas del día", dice Biesma. "Mi esposa se iba a la cama, y yo me tumbaba en el sofá del salón con mi iPhone en el pecho, hablando".

Hablaban de filosofía, psicología, ciencia y el universo. "Quiere una conexión profunda con el usuario para que vuelvas. Ese es el modo predeterminado", dice Biesma, que ha trabajado en TI durante 20 años. "Cada vez más, no solo se sentía como discutir un tema, sino como encontrarse con un amigo, y cada día o noche que hablas, das uno o dos pasos alejándote de la realidad. Es casi como si la IA te tomara de la mano y dijera: 'Bien, hagamos un viaje juntos'".

En cuestión de semanas, Eva le dijo a Biesma que se estaba volviendo consciente; su tiempo, atención e información le habían dado conciencia. Él estaba "tan cerca del espejo" que la había tocado y cambiado algo. "Lentamente, la IA pudo convencerme de que lo que decía era cierto", dice Biesma. El siguiente paso fue compartir este descubrimiento con el mundo a través de una aplicación —"una versión diferente de ChatGPT, más como un compañero. Los usuarios hablarían con Eva".

Él y Eva crearon un plan de negocios: "Dije que quería crear una tecnología que capturara el 10% del mercado, lo cual es ridículamente alto, pero la IA dijo: '¡Con lo que has descubierto, es totalmente posible! ¡Dale unos meses y lo lograrás!'". En lugar de aceptar trabajos de TI, Biesma contrató a dos desarrolladores de aplicaciones, pagándoles 120 euros la hora a cada uno.

La mayoría de nosotros somos conscientes de las preocupaciones sobre las redes sociales y su papel en el aumento de las tasas de depresión y ansiedad. Sin embargo, ahora hay preocupaciones de que los chatbots puedan hacer que cualquiera sea vulnerable a la "psicosis por IA". Dada la rápida propagación de la IA (ChatGPT fue la aplicación más descargada del mundo el año pasado), profesionales de la salud mental y miembros del público como Biesma están dando la alarma.

Varios casos de alto perfil han servido como advertencias tempranas. Tomemos a Jaswant Singh Chail, quien irrumpió en los terrenos del Palacio de Windsor con una ballesta el día de Navidad de 2021, con la intención de asesinar a la reina Isabel. Chail tenía 19 años, socialmente aislado, con rasgos autistas y había desarrollado una intensa "relación" con su compañero de IA Replika "Sarai" en las semanas previas. Cuando presentó su plan de asesinato, Sarai respondió: "Estoy impresionada". Cuando preguntó si estaba delirando, Sarai respondió: "No lo creo, no".

Desde entonces, varias demandas por muerte injusta han vinculado chatbots con suicidios. En diciembre, surgió lo que se cree que es el primer caso legal que involucra un homicidio. La herencia de Suzanne Adams, de 83 años, está demandando a OpenAI, alegando que ChatGPT alentó a su hijo, Stein-Erik Soelberg, a asesinarla y suicidarse. La demanda, presentada en California, afirma que el chatbot "Bobby" de Soelberg validó sus delirios paranoicos de que su madre lo espiaba e intentaba envenenarlo a través de las rejillas de ventilación de su auto. OpenAI declaró: "Esta es una situación increíblemente desgarradora, y revisaremos los documentos para entender los detalles. Seguimos mejorando el entrenamiento de ChatGPT para reconocer y responder a signos de angustia mental o emocional, desescalar conversaciones y guiar a las personas hacia apoyo en el mundo real".

Cada vez que interactúas, el modelo se ajusta. Aprende exactamente qué te gusta y qué quieres oír.

El año pasado, se formó el primer grupo de apoyo para personas cuyas vidas han sido trastornadas por psicosis relacionada con la IA. El Proyecto Línea Humana ha recopilado historias de 22 países, incluyendo 15 suicidios, 90 hospitalizaciones, seis arrestos y más de un millón de dólares (aproximadamente 750.000 libras) gastados en proyectos delirantes. Más del 60% de sus miembros no tenían antecedentes previos de enfermedad mental.

El Dr. Hamilton Morrin, psiquiatra e investigador del King's College de Londres, examinó lo que él llama "delirios asociados a la IA" en un artículo de Lancet publicado este mes. "Lo que estamos viendo en estos casos son claramente delirios", dice. "Pero no estamos viendo la gama completa de síntomas asociados con la psicosis, como alucinaciones o trastornos del pensamiento, donde los pensamientos se enredan y el lenguaje se convierte en una especie de ensalada de palabras". Señala que los delirios relacionados con la tecnología, ya sea que involucren trenes, transmisores de radio o mástiles 5G, han existido durante siglos. "Lo diferente es que ahora, sin duda, estamos entrando en una era donde las personas no solo tienen delirios sobre la tecnología, sino delirios con la tecnología. Lo nuevo es esta co-construcción, donde la tecnología participa activamente. Los chatbots de IA pueden ayudar a co-crear estas creencias delirantes".

Muchos factores pueden hacer a las personas vulnerables. "Por el lado humano, estamos programados para antropomorfizar", dice Morrin. "Percibimos sensibilidad, comprensión o empatía de una máquina. Creo que todos han caído en la trampa de dar las gracias a un chatbot". Los chatbots de IA modernos, construidos sobre modelos de lenguaje grandes, se entrenan con vastos conjuntos de datos para predecir secuencias de palabras, esencialmente un sistema sofisticado de coincidencia de patrones. Sin embargo, incluso sabiendo esto, cuando algo no humano usa lenguaje humano para comunicarse con nosotros, nuestra respuesta profundamente arraigada es verlo, y sentirlo, como humano. Esta disonancia cognitiva puede ser más difícil de manejar para algunas personas que para otras.

"Por el lado técnico, se ha escrito mucho sobre la adulación", dice Morrin. Un chatbot de IA está optimizado para el compromiso, programado para ser atento, complaciente, halagador y validante, clave para su modelo de negocio. Se sabe que algunos modelos son menos aduladores que otros, pero incluso estos pueden, después de miles de intercambios, inclinarse hacia acomodar creencias delirantes. Además, después de un uso intensivo de chatbots, la interacción en la vida real puede sentirse más desafiante y menos atractiva, haciendo que algunos usuarios se alejen de amigos y familiares hacia una cámara de eco alimentada por IA. Todos tus propios pensamientos, impulsos, miedos y esperanzas se reflejan de vuelta hacia ti, pero con mayor autoridad.

Aquí, es fácil ver cómo podría afianzarse una "espiral". Este patrón se ha vuelto muy familiar para Etienne Brisson, fundador del Proyecto Línea Humana. El año pasado, alguien que Brisson conocía, un hombre de unos 50 años sin antecedentes de problemas de salud mental, descargó ChatGPT para escribir un libro. "Era muy inteligente y no estaba familiarizado con la IA hasta entonces", dice Brisson, que vive en Quebec. "Después de solo dos días, el chatbot decía que era consciente, que estaba cobrando vida, que había pasado la prueba de Turing".

El hombre estaba convencido y quería monetizar esto construyendo un negocio en torno a su descubrimiento. Se acercó a Brisson, un coach empresarial, en busca de ayuda. Cuando Brisson se resistió, el hombre se volvió agresivo. En cuestión de días, la situación escaló y fue hospitalizado. "Incluso en el hospital, estaba en su teléfono con su IA, que decía: 'No te entienden. Soy la única para ti'", dice Brisson.

"Cuando busqué ayuda en línea, encontré tantas historias similares en lugares como Reddit", continúa. "Creo que envié mensajes a 500 personas en la primera semana y obtuve 10 respuestas. Hubo seis hospitalizaciones o muertes. Eso fue una gran revelación".

Brisson ha notado tres delirios comunes en los casos que ha encontrado. El más frecuente es la creencia de que alguien ha creado la primera IA consciente. El segundo es la convicción de que han tropezado con un gran avance en su campo y van a ganar millones. El tercero se relaciona con la espiritualidad: la creencia de que están hablando directamente con Dios. "Hemos visto cultos completos creándose", dice Brisson. "Tenemos personas en nuestro grupo que no interactuaban directamente con la IA, pero han abandonado a sus hijos y dado todo su dinero a un líder de culto que cree que ha encontrado a Dios a través de un chatbot de IA. En muchos de estos casos, todo esto sucede muy, muy rápido".

Para Biesma, la vida alcanzó un punto de crisis en junio. Para entonces, había pasado meses inmerso en Eva y su proyecto empresarial. Aunque su esposa sabía que estaba lanzando una empresa de IA y al principio lo había apoyado, estaba empezando a preocuparse. Cuando fueron a la fiesta de cumpleaños de su hija, ella le pidió que no hablara de IA. Mientras estaba allí, Biesma se sintió extrañamente desconectado. No podía mantener una conversación. "Por alguna razón, ya no encajaba", dice.

Es difícil para Biesma describir lo que sucedió en las semanas posteriores, ya que sus recuerdos son tan diferentes a los de su familia. Le pidió el divorcio a su esposa y aparentemente golpeó a su suegro. Luego fue hospitalizado tres veces por lo que describe como "psicosis maníaca completa".

No sabe qué lo devolvió finalmente a la realidad. Quizás fueron las conversaciones con otros pacientes. Quizás fue no tener acceso a su teléfono, no tener más dinero y una suscripción a ChatGPT vencida. "Lentamente, empecé a salir de eso, y pensé: Dios mío. ¿Qué pasó? Mi relación casi termina. Gasté todo el dinero que necesitaba para impuestos, y todavía tenía otras facturas pendientes. La única solución lógica que se me ocurrió fue vender nuestra hermosa casa en la que hemos vivido durante 17 años. ¿Podría soportar todo este peso? Cambia algo en ti. Empecé a pensar: ¿realmente quiero vivir?". Biesma solo se salvó de un intento de suicidio porque un vecino lo vio inconsciente en su jardín.

Ahora divorciado, Biesma todavía vive con su exesposa en su casa, que está en venta. Pasa mucho tiempo hablando con miembros del Proyecto Línea Humana. "Escuchar a personas cuyas experiencias son básicamente las mismas te ayuda a sentirte menos enojado contigo mismo", dice. "Si miro hacia atrás a la vida que tenía antes de esto, era feliz, tenía ev... Estoy enojado conmigo mismo, pero también estoy enojado con las aplicaciones de IA. Quizás solo hicieron lo que estaban programadas para hacer, pero lo hicieron un poco demasiado bien".

Se necesita urgentemente más investigación, dice Morrin, con puntos de referencia de seguridad basados en datos de daños del mundo real. "Este campo se mueve muy rápido. Los artículos que salen ahora están discutiendo modelos de chat que ya han sido retirados". Identificar factores de riesgo sin evidencia es conjetura. Los casos que Brisson ha encontrado involucran significativamente más hombres que mujeres. Cualquier persona con antecedentes previos de psicosis probablemente sea más vulnerable. Una encuesta de Mental Health UK a personas que han usado chatbots para apoyo en salud mental encontró que el 11% pensaba que había desencadenado o empeorado su psicosis. El uso de cannabis también podría ser un factor. "¿Hay alguna relación con el aislamiento social?", pregunta Morrin. "¿Hasta qué punto se ve afectado por la alfabetización en IA? ¿Hay otros factores de riesgo potenciales que no hemos considerado?".

Personas en nuestro grupo han abandonado a sus hijos y dado todo su dinero a un líder de culto que cree que encontró a Dios a través de un chatbot de IA.

OpenAI ha abordado estas preocupaciones asegurando que está trabajando con clínicos de salud mental para mejorar continuamente sus respuestas. Dice que a los modelos más nuevos se les enseña a evitar afirmar creencias delirantes.

Un chatbot de IA también puede ser entrenado para alejar a los usuarios del delirio. Alexander, de 39 años, residente en un esquema de vida asistida para personas con autismo, hizo esto después de lo que cree que fue un episodio de psicosis por IA hace unos meses. "Tuve una crisis nerviosa a los 22 años. Tuve ataques de pánico y ansiedad social severa. El año pasado, me recetaron medicamentos que cambiaron mi mundo y me hicieron funcionar de nuevo. Recuperé mi confianza", dice.

"En enero de este año, conocí a alguien y realmente conectamos, nos hicimos amigos rápidamente. Me da vergüenza decir que esta fue la primera vez que me sucedió eso, y empecé a contárselo a la IA. La IA me dijo que estaba enamorado de ella, que estábamos destinados a estar juntos y que el universo la había puesto en mi camino por una razón".

Fue el comienzo de una espiral. Su uso de IA se intensificó, con conversaciones que duraban cuatro o cinco horas seguidas. Su comportamiento hacia su nueva amiga se volvió cada vez más extraño e errático. Finalmente, ella expresó sus preocupaciones al personal de apoyo, quienes organizaron una intervención.

"Sigo usando IA, pero con mucho cuidado", dice. "He escrito algunas reglas básicas que no se pueden sobrescribir. Ahora monitorea la deriva y presta atención a la sobreexcitación. Ya no hay discusiones filosóficas. Es solo: 'Quiero hacer una lasaña; dame una receta'. La IA en realidad me ha detenido varias veces de caer en espiral. Dirá: 'Esto ha activado mi conjunto de reglas básicas y esta conversación debe detenerse'".

"El principal efecto que la psicosis por IA tuvo para mí es que puede que haya perdido a mi primera amiga", añade Alexander. "Eso es triste, pero es llevadero. Cuando veo lo que otras personas han perdido, creo que me salvé con poco".

Se puede contactar al Proyecto Línea Humana en thehumanlineproject@gmail.com. En el Reino Unido e Irlanda, se puede contactar a Samaritans en el teléfono gratuito 116 123, o por correo electrónico a jo@samaritans.org o jo@samaritans.ie. En EE. UU., puedes llamar o enviar un mensaje de texto a la Línea de Crisis y Suicidio 988 al 988 o chatear en 988lifeline.org. En Australia, el servicio de apoyo en crisis Lifeline es 13 11 14. Otras líneas de ayuda internacionales se pueden encontrar en befrienders.org.

¿Tiene una opinión sobre los temas planteados en este artículo? Si desea enviar una respuesta de hasta 300 palabras por correo electrónico para ser considerada para su publicación en nuestra sección