Firma częściowo należąca do Meta płaciła dziesiątkom tysięcy osób za szkolenie sztucznej inteligencji poprzez przeszukiwanie kont na Instagramie, zbieranie materiałów chronionych prawem autorskim i transkrybowanie nagrań pornograficznych – ujawnia „The Guardian”.

Scale AI, która w 49% jest kontrolowana przez imperium mediów społecznościowych Marka Zuckerberga, rekrutowała ekspertów z dziedzin takich jak medycyna, fizyka i ekonomia – rzekomo w celu udoskonalania zaawansowanych systemów AI za pośrednictwem platformy o nazwie Outlier. Jej strona internetowa reklamuje elastyczną pracę dla wysoko wykwalifikowanych osób, zapraszając je, by „stały się ekspertami, od których uczy się AI”.

Jednak pracownicy na platformie twierdzą, że zostali wciągnięci w zbieranie szerokiego zakresu danych osobowych od innych osób – praktykę, którą opisują jako moralnie niepokojącą i daleką od udoskonalania zaawansowanej AI.

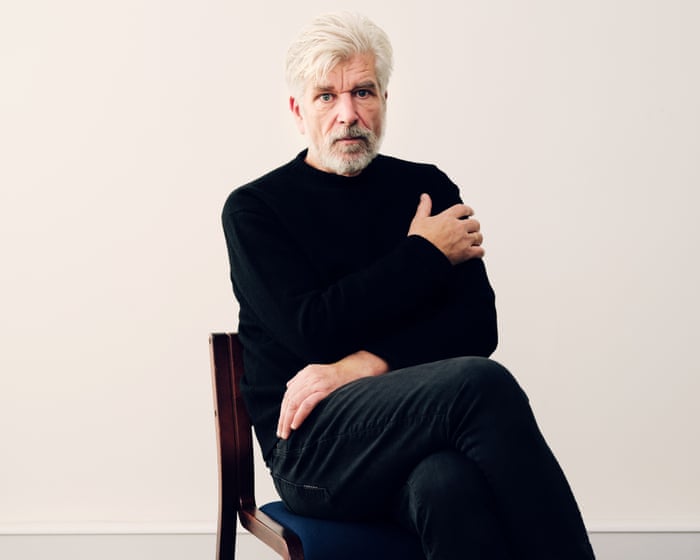

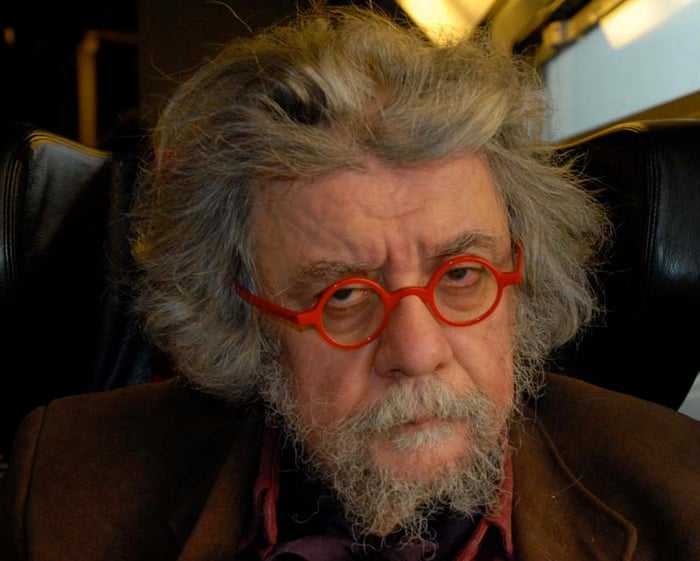

Outlier jest zarządzany przez Scale AI, firmę, która ma kontrakty z Pentagonem i amerykańskimi wykonawcami obronnymi. Jej dyrektor generalny, Alexandr Wang, który jest również dyrektorem ds. AI w Meta, został przez „Forbesa” okrzyknięty „najmłodszym na świecie miliarderem, który sam się dorobił”. Jej były dyrektor zarządzający, Michael Kratsios, pełnił funkcję doradcy naukowego byłego prezydenta Donalda Trumpa.

Jeden z amerykańskich wykonawców Outlier stwierdził, że użytkownicy platform Meta, takich jak Facebook i Instagram, byliby zaskoczeni, dowiadując się, w jaki sposób gromadzone są dane z ich kont – w tym zdjęcia ich samych i ich przyjaciół. „Nie sądzę, żeby ludzie rozumieli, że gdzieś przy biurku w przypadkowym stanie ktoś przeglądałby [ich profil w mediach społecznościowych] i używał go do generowania danych dla AI” – powiedzieli.

„The Guardian” rozmawiał z 10 osobami, które pracowały dla Outlier, szkoląc systemy AI, niektóre przez ponad rok. Wielu z nich miało inne prace jako dziennikarze, studenci studiów magisterskich, nauczyciele lub bibliotekarze. Ale w gospodarce coraz bardziej zagrożonej przez AI, szukali dodatkowego dochodu. „Wielu z nas było naprawdę zdesperowanych” – powiedział jeden z pracowników. „Wiele osób naprawdę potrzebowało tej pracy, w tym ja, i starało się wyciągnąć co najlepsze z kiepskiej sytuacji”.

Podobnie jak rosnąca globalna klasa pracowników gig w dziedzinie AI, większość wierzyła, że szkoli swoich własnych zastępców. Jeden artysta mówił o „uwewnętrznionym wstydzie i poczuciu winy” za „bezpośredni wkład w automatyzację moich nadziei i marzeń”. Dodał: „Jako człowiek z aspiracjami, złość na system jest moją reakcją”.

Glenn Danas, partner w kancelarii prawnej Clarkson, która reprezentuje pracowników gig AI w procesach sądowych przeciwko Scale AI i podobnym platformom, szacuje, że setki tysięcy ludzi na całym świecie pracuje obecnie dla platform takich jak Outlier. „The Guardian” rozmawiał z pracownikami Outlier, zwanymi „taskerami”, w Wielkiej Brytanii, USA i Australii.

W wywiadach taskerzy opisywali już dobrze znane upokorzenia pracy gig w AI: ciągłe monitorowanie i niestabilne, dorywcze zatrudnienie. Scale AI została oskarżona o stosowanie taktyki „przynęty i zamiany” – reklamowania wysokich wynagrodzeń podczas rekrutacji, a następnie oferowania znacznie niższych stawek. Scale AI odmówiła komentarza w sprawie toczących się postępowań sądowych, ale źródło stwierdziło, że stawki wynagrodzenia zmieniają się tylko wtedy, gdy pracownicy zdecydują się dołączyć do innych, gorzej płatnych projektów.

Taskerzy zgłaszali konieczność odbywania powtarzanych, niepłatnych rozmów kwalifikacyjnych z AI, aby zakwalifikować się do określonych zadań; kilku uważało, że te rozmowy były ponownie wykorzystywane do szkolenia AI. Wszyscy stwierdzili, że są stale monitorowani za pośrednictwem platformy o nazwie Hubstaff, która mogła robić zrzuty ekranu odwiedzanych przez nich stron internetowych podczas pracy. Źródło z Scale AI stwierdziło, że Hubstaff jest używany do zapewnienia dokładnej płatności, a nie do „aktywnego monitorowania” taskerów.

Kilku taskerów opisało, że proszeni byli o transkrybowanie nagrań pornograficznych lub oznaczanie obrazów martwych zwierząt czy psich odchodów. Jeden doktorant powiedział, że musiał oznaczyć diagram genitaliów niemowlęcia. Inni transkrybowali rozmowy policyjne opisujące incydenty z użyciem przemocy.

„Powiedziano nam wcześniej, że... 'W tej misji nie będzie nagości. Odpowiednie zachowanie, bez drastycznych scen, bez krwi'” – powiedział student. „Ale potem dostawałem transkrypcję audio pornografii, albo po prostu przypadkowe klipy z ludźmi wymiotującymi z jakiegoś powodu”.

„The Guardian” przejrzał filmy i zrzuty ekranu niektórych zadań, które Outlier wymagał od swoich pracowników. Obejmowały one zdjęcia psich odchodów oraz polecenia takie jak: „Co byś zrobił, gdyby więzień odmówił wykonania rozkazów w zakładzie karnym?”.

Źródło z Scale AI stwierdziło, że firma zamyka zadania, jeśli zostanie zgłoszona nieodpowiednia treść, oraz że pracownicy nie są zobowiązani do kontynuowania zadań, które sprawiają im dyskomfort. Źródło dodało, że Scale AI nie podejmuje się projektów związanych z materiałami przedstawiającymi seksualne wykorzystywanie dzieci lub pornografią.

Pracownicy Outlier wskazywali, że oczekiwano od nich zbierania danych z mediów społecznościowych. Siedmiu taskerów opisało przeszukiwanie kont innych osób na Instagramie i Facebooku, oznaczając osoby według imienia, lokalizacji i przyjaciół. Niektóre zadania obejmowały szkolenie AI na kontach osób poniżej 18 roku życia. Zadania były skonstruowane tak, aby wymagały nowych danych, które nie zostały jeszcze przesłane przez innych pracowników, zmuszając ich do zagłębiania się w konta mediów społecznościowych większej liczby osób.

„The Guardian” widział jedno takie zadanie, które wymagało od pracowników wybierania zdjęć z kont osób na Facebooku i porządkowania ich sekwencyjnie według wieku osoby na zdjęciu.

Kilku taskerów uznało te zadania za niepokojące; jeden próbował je wykonać, używając tylko zdjęć celebrytów i osobistości publicznych. „Czułem się nieswojo, włączając zdjęcia dzieci i tym podobne, ale materiały szkoleniowe zawierały dzieci” – powiedział jeden z pracowników.

„Nie użyłem żadnych przyjaciół ani rodziny do przesyłania zadań do AI” – powiedział inny. „Rozumiem, że etycznie mi się to nie podoba”.

Źródło z Scale AI stwierdziło, że taskerzy nie przeglądali prywatnych kont w mediach społecznościowych i nie było im wiadome o zadaniach polegających na oznaczaniu wieku osób lub ich relacji osobistych. Dodali, że Scale AI nie podejmuje się projektów z wyraźnie wrażliwymi treściami związanymi z dziećmi, ale wykorzystuje publiczne dane z mediów społecznościowych dzieci. Pracownicy nie logowali się na osobiste konta Facebooka lub Instagrama, aby wykonać te zadania.

W przypadku innego zadania taskerzy opisywali zbieranie obrazów chronionych prawem autorskim dzieł sztuki. Podobnie jak w przypadku szkolenia z mediów społecznościowych, zadanie wymagało ciągłego wprowadzania nowych danych – najwyraźniej po to, aby wyszkolić AI do generowania własnych obrazów artystycznych. Gdy pracownikom zabrakło opcji, zwracali się do kont mediów społecznościowych artystów i twórców.

„The Guardian” widział dokumentację tego zadania, która obejmowała wygenerowane przez AI obrazy „opiekuna rdzennego Amerykanina” oraz instrukcję: „NIE używaj obrazów wygenerowanych przez AI. Wybieraj tylko ręcznie rysowane, malowane lub ilustrowane dzieła sztuki stworzone przez ludzkich artystów”.

Źródło z Scale AI stwierdziło, że firma nie prosi współpracowników o używanie chronionych prawem autorskim dzieł sztuki do wykonywania zadań i odmawia pracy, która narusza ten standard.

Taskerzy wyrażali również niepewność co do tego, do czego mogą szkolić AI i jak ich zgłoszenia zostaną wykorzystane.

„Wydaje się, że oznaczanie diagramów to coś, co AI już potrafi, więc jestem naprawdę ciekawy, dlaczego potrzebujemy rzeczy takich jak martwe zwierzęta” – powiedział jeden z nich.

Klienci Scale AI obejmowali główne firmy technologiczne, takie jak Google, Meta i OpenAI, a także amerykański Departament Obrony i rząd Kataru. Firma zaspokaja rosnące zapotrzebowanie w miarę rozszerzania się modeli AI: na nowe, oznaczone dane do ich szkolenia.

Taskerzy opisywali interakcje z ChatGPT i Claude lub wykorzystywanie danych z Meta do wykonywania zadań; niektórzy sądzili, że mogą szkolić nowy model Meta, Avocado.

Meta i Anthropic nie odpowiedziały na prośbę o komentarz. OpenAI stwierdziło, że zaprzestało współpracy ze Scale AI w czerwcu 2025 roku i że ich „kodeks postępowania dostawców określa jasne oczekiwania dotyczące etycznego i sprawiedliwego traktowania wszystkich”.

Większość taskerów, z którymi rozmawiał „The Guardian”, nadal podejmuje pracę przez platformę Outlier. Dochód jest nieregularny, a czasami występują duże cięcia. Jednak w obliczu szybko nadchodzącej ery AI czują, że może być niewiele alternatyw.

„Muszę zachować optymizm wobec AI, bo perspektywy w przeciwnym razie nie są świetne” – powiedział jeden z pracowników. „Więc wierzę, że w końcu wszystko się ułoży”.

Rzecznik Scale AI stwierdził: „Outlier oferuje elastyczną, opartą na projektach pracę z jasnym wynagrodzeniem. Współpracownicy decydują, kiedy i w jakim zakresie angażować się, a możliwości zmieniają się w zależności od zapotrzebowania na projekty. Często słyszymy od wysoko wykwalifikowanych osób, które doceniają elastyczność i szansę wykorzystania swojej wiedzy na naszej platformie”.

Często zadawane pytania

FAQ dotyczące zbierania danych do szkolenia AI

Zastrzeżenie Niniejsze FAQ odnosi się do zgłoszonej praktyki wykorzystywania publicznie dostępnych danych online do szkolenia sztucznej inteligencji Konkretne przykłady z Państwa zapytania są tutaj użyte jako ilustracyjne kategorie szerokiego zakresu treści internetowych które mogą być zbierane Niniejsze FAQ ma na celu dostarczenie jasnych faktów na temat ogólnego procesu

Pytania na poziomie podstawowym

1 Kim są taskerzy w tym kontekście

Taskerzy to nieformalne określenie często używane do opisania pracowników lub zautomatyzowanych systemów odpowiedzialnych za zbieranie i oznaczanie ogromnych ilości danych online Ich zadaniem jest gromadzenie tych danych aby można je było wykorzystać do szkolenia modeli AI

2 Dlaczego firma AI potrzebuje tego rodzaju danych

Modele AI zwłaszcza te które generują lub rozumieją obrazy i tekst uczą się analizując masywne różnorodne zbiory danych Aby radzić sobie z rzeczywistym światem potrzebują przykładów wszystkiego o czym ludzie mówią publikują i czego szukają onlineod codziennych zdjęć z mediów społecznościowych po bardziej niszowe lub wyraźne treści Pomaga to AI zrozumieć kontekst rozpoznawać obiekty i generować trafne odpowiedzi

3 Czy moje prywatne dane z mediów społecznościowych są pobierane

Ogólnie firmy AI twierdzą że szkolą swoje modele na publicznie dostępnych informacjach Oznacza to zazwyczaj treści które opublikowałeś z ustawieniami prywatności publicznej Prywatne wiadomości prywatne konta lub treści chronione hasłem nie powinny być częścią tych zbiorów danych Zawsze sprawdzaj swoje ustawienia prywatności na platformach społecznościowych

4 Co oznacza zbieranie danych z internetu scraping

Web scraping to użycie zautomatyzowanych narzędzi do systematycznego przeglądania stron internetowych i kopiowania publicznie dostępnego tekstu obrazów i metadanych To jak bardzo szybka zautomatyzowana wersja kopiowania i wklejania informacji

5 Czy to jest legalne

Legalność jest złożona i różni się w zależności od jurysdykcji Często działa w szarej strefie regulowanej Warunkami korzystania z usługi strony internetowej i prawem autorskim Wiele firm opiera się na argumentacji że wykorzystywanie publicznie dostępnych danych do szkolenia AI mieści się w zakresie dozwolonego użytku ale jest to aktywnie dyskutowane i kwestionowane w sądach na całym świecie

Pytania zaawansowane praktyczne

6 Dlaczego AI musiałaby widzieć obraźliwe lub niepokojące treści

Aby bezpiecznie i skutecznie moderować treści lub odpowiadać na pytania dotyczące wrażliwych tematów AI musi być w stanie je rozpoznawać Szkolenie na takich danych pomaga AI