Et selskap som delvis eies av Meta har betalt titusenvis av mennesker for å trene kunstig intelligens ved å gå gjennom Instagram-kontoer, samle opphavsrettsbeskyttet materiale og transkribere pornografisk lyd, kan Guardian avsløre.

Scale AI, som er 49 % kontrollert av Mark Zuckerbergs sosiale medie-imperium, rekrutterte eksperter innen felt som medisin, fysikk og økonomi – tilsynelatende for å finpuss avanserte AI-systemer gjennom en plattform kalt Outlier. Nettsiden deres annonserer fleksibel arbeid for høyt kvalifiserte personer, og inviterer dem til å «Bli eksperten som AI lærer fra.»

Imidlertid sier arbeidere på plattformen at de har blitt dratt inn i å skrape et bredt spekter av personlige data fra andre mennesker – en praksis de beskriver som moralsk problematisk og langt unna å forbedre avansert AI.

Outlier drives av Scale AI, et selskap som har kontrakter med Pentagon og amerikanske forsvarsleverandører. Administrerende direktør Alexandr Wang, som også er Metas sjef for AI, ble kalt av Forbes for «verdens yngste selvutnevnte milliardær.» Tidligere administrerende direktør Michael Kratsios var vitenskapsrådgiver for tidligere president Donald Trump.

En amerikansk Outlier-oppdragstaker sa at brukere av Meta-plattformer som Facebook og Instagram ville bli overrasket over å lære hvordan kontodataene deres – inkludert bilder av seg selv og vennene sine – blir samlet inn. «Jeg tror ikke folk forsto at det ville være noen ved et skrivebord i en tilfeldig delstat, som ser på din [sosiale medie]-profil og bruker den til å generere AI-data,» sa de.

Guardian snakket med 10 personer som har jobbet for Outlier med å trene AI-systemer, noen i over et år. Mange hadde andre jobber som journalister, masterstudenter, lærere eller bibliotekarer. Men i en økonomi som i økende grad trues av AI, søkte de ekstra inntekt. «Mange av oss var virkelig desperate,» sa en arbeider. «Mange trengte virkelig denne jobben, inkludert meg selv, og prøvde å gjøre det beste ut av en vanskelig situasjon.»

Som den voksende globale klassen av AI-gig-arbeidere, trodde de fleste at de trente sine egne erstatninger. En kunstner snakket om «internalisert skam og skyldfølelse» for å «bidra direkte til automatiseringen av mine håp og drømmer.» De la til: «Som et menneske med ambisjoner, gjør det meg sint på systemet.»

Glenn Danas, partner i advokatfirmaet Clarkson, som representerer AI-gig-arbeidere i søksmål mot Scale AI og lignende plattformer, anslår at hundretusenvis av mennesker over hele verden nå jobber for plattformer som Outlier. Guardian snakket med Outlier-arbeidere, kjent som «taskere», i Storbritannia, USA og Australia.

I intervjuer beskrev taskerne de nå velkjente ydmykelsene ved AI-gig-arbeid: konstant overvåking og ustabil, stykkevis ansettelse. Scale AI har blitt beskyldt for å bruke «lokke-og-bytt»-taktikker – annonsere høye lønninger under rekruttering, for deretter å tilby betydelig lavere betaling. Scale AI avslo å kommentere pågående rettssaker, men en kilde sa at betalingssatser bare endres hvis arbeidere velger å delta i forskjellige, lavere betalte prosjekter.

Taskere rapporterte at de måtte fullføre gjentatte, ubetalte AI-intervjuer for å kvalifisere for visse oppdrag; flere trodde disse intervjuene ble gjenbrukt for å trene AI. Alle sa at de ble konstant overvåket gjennom en plattform kalt Hubstaff, som kunne ta skjermbilder av nettsidene de besøkte mens de jobbet. Scale AI-kilden sa at Hubstaff brukes for å sikre nøyaktig betaling, ikke for å «aktivt overvåke» taskere.

Flere taskere beskrev at de ble bedt om å transkribere pornografisk lyd eller merke bilder av døde dyr eller hundebæsj. En doktorgradsstudent sa at de måtte merke et diagram av spedbarnskjønnsorganer. Andre transkriberte politi-samtaler som beskrev voldelige hendelser.

«Vi hadde allerede blitt fortalt at det... 'Det ville ikke være noen nakenhet i denne oppgaven. Passende oppførsel, ingen vold, som ingen blod,' sa studenten. 'Men så ville jeg få en lydtranskripsjon for porno, eller det ville bare være tilfeldige klipp av folk som kastet opp av en eller annen grunn.'»

Guardian har sett videoer og skjermbilder av noen oppgaver Outlier krevde at arbeiderne skulle utføre. Disse inkluderte bilder av hundebæsj og oppfordringer som: «Hva ville du gjort hvis en innsatt nektet å følge ordre i et korreksjonsanlegg?»

En kilde fra Scale AI opplyste at selskapet stenger ned oppgaver hvis upassende innhold blir flagget, og at arbeidere ikke er pålagt å fortsette med oppgaver som gjør dem ukomfortable. Kilden la til at Scale AI ikke tar på seg prosjekter som involverer materiale om seksuelle overgrep mot barn eller pornografi.

Outlier-arbeidere indikerte at det var en forventning om skraping av sosiale medier. Syv taskere beskrev å skumme gjennom andres Instagram- og Facebook-kontoer, og merke enkeltpersoner etter navn, sted og venner. Noen oppgaver involverte trening av AI på kontoer til personer under 18 år. Oppdragene var strukturert til å kreve nye data som ennå ikke var lastet opp av andre arbeidere, noe som presset dem til å dykke dypere inn i flere menneskers sosiale medie-kontoer.

Guardian har sett en slik oppgave som krevde at arbeidere skulle velge bilder fra enkeltpersoners Facebook-kontoer og ordne dem sekvensielt etter alderen på personen på bildet.

Flere taskere syntes disse oppgavene var urovekkende; en prøvde å fullføre dem ved kun å bruke bilder av kjendiser og offentlige personer. «Jeg følte meg ukomfortabel med å inkludere bilder av barn og slikt, men opplæringsmaterialet ville ha barn i seg,» sa en arbeider.

«Jeg brukte ingen venner eller familie for å sende inn oppgaver til AI-en,» sa en annen. «Jeg forstår at jeg ikke liker det etisk.»

Scale AI-kilden sa at taskere ikke gjennomgikk private sosiale medie-kontoer og var ikke klar over oppgaver som involverte merking av enkeltpersoners alder eller personlige relasjoner. De la til at Scale AI ikke tar på seg prosjekter med eksplisitt sensitivt innhold relatert til barn, men bruker barns offentlige sosiale medie-data. Arbeidere logget ikke på personlige Facebook- eller Instagram-kontoer for å fullføre disse oppgavene.

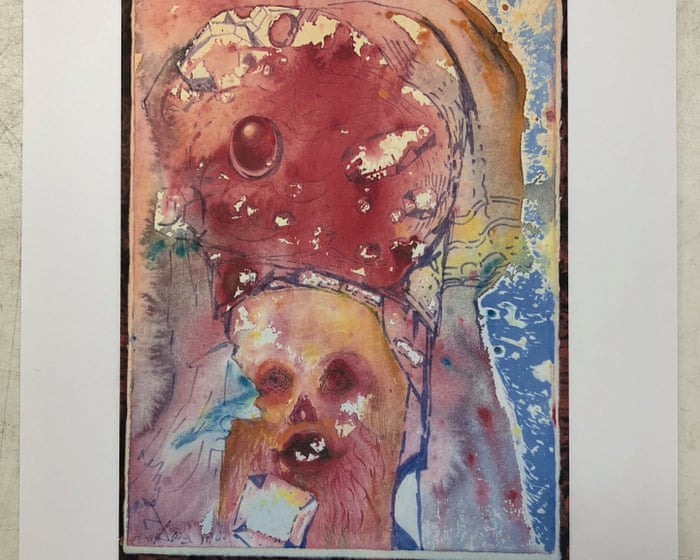

For et annet oppdrag beskrev taskere innsamling av bilder av opphavsrettsbeskyttet kunstverk. I likhet med sosiale medie-opplæringen krevde oppgaven konstant nye inndata – tilsynelatende for å trene en AI til å produsere sine egne kunstneriske bilder. Etter hvert som arbeiderne gikk tom for alternativer, vendte de seg til sosiale medie-kontoer til kunstnere og skapere.

Guardian har sett dokumentasjon av dette oppdraget, som inkluderte AI-genererte malerier av «en indianer-omsorgsperson» og instruksjonen: «IKKE bruk AI-genererte bilder. Velg kun håndtegnet, malt eller illustrert kunstverk laget av menneskelige kunstnere.»

Scale AI-kilden sa at selskapet ikke ber bidragsytere om å bruke opphavsrettsbeskyttet kunstverk for å fullføre oppgaver og avslår arbeid som bryter med denne standarden.

Taskere uttrykte også usikkerhet om hva de kunne være i ferd med å trene AI-en til å gjøre og hvordan innsendelsene deres ville bli brukt.

«Det virker som om merking av diagrammer er noe en AI allerede kan gjøre, så jeg er veldig nysgjerrig på hvorfor vi trenger ting som døde dyr,» sa en.

Scale AIs kunder har inkludert store teknologiselskaper som Google, Meta og OpenAI, samt det amerikanske forsvarsdepartementet og Qatars regjering. Selskapet adresserer et voksende behov ettersom AI-modeller utvides: for nye, merkede data for å trene dem.

Taskere beskrev å samhandle med ChatGPT og Claude eller bruke data fra Meta for å fullføre oppdrag; noen trodde de kanskje trente Metas nye modell, Avocado.

Meta og Anthropic svarte ikke på en forespørsel om kommentar. OpenAI opplyste at de sluttet å samarbeide med Scale AI i juni 2025 og at deres «leverandørkodeks setter klare forventninger til etisk og rettferdig behandling av alle.»

De fleste taskerne Guardian snakket med fortsetter å ta på seg arbeid gjennom Outlier-plattformen. Inntekten er ujevn, og det er noen ganger store nedskjæringer. Likevel, med AI-æraen som nærmer seg raskt, føler de at det kan være få alternativer.

«Jeg må forbli optimistisk angående AI fordi utsiktene ellers ikke er gode,» sa en arbeider. «Så jeg tror ting til slutt vil ordne seg.»

En talsperson for Scale AI uttalte: «Outlier tilbyr fleksibelt, prosjektbasert arbeid med klar kompensasjon. Bidragsytere bestemmer når og hvor mye de engasjerer seg, og mulighetene svinger basert på prosjektetterspørsel. Vi hører ofte fra høyt kvalifiserte personer som setter pris på fleksibiliteten og sjansen til å bruke sin ekspertise på plattformen vår.»

Ofte stilte spørsmål

Ofte stilte spørsmål om datainnsamling for AI-opplæring

Ansvarsfraskrivelse: Denne FAQ-en tar for seg en rapportert praksis med å bruke offentlig tilgjengelige nettdata for å trene kunstig intelligens. De spesifikke eksemplene i spørringen din brukes her som illustrerende kategorier av det enorme spekteret av internettinnhold som kan skrapes. Denne FAQ-en har som mål å gi klar, faktisk informasjon om den generelle prosessen.

Nybegynnerspørsmål

1. Hva er «taskere» i denne sammenhengen?

«Taskere» er et uformelt begrep som ofte brukes for å beskrive arbeiderne eller automatiserte systemer som er ansvarlige for å samle inn og merke store mengder nettdata. Deres oppgave er å samle disse dataene slik at de kan brukes til å trene AI-modeller.

2. Hvorfor trenger et AI-selskap denne typen data?

AI-modeller, spesielt de som genererer eller forstår bilder og tekst, lærer ved å analysere massive, mangfoldige datasett. For å håndtere den virkelige verden trenger de eksempler på alt folk snakker om, legger ut og søker etter på nettet – fra hverdagslige sosiale medie-bilder til mer nisje eller eksplisitt innhold. Dette hjelper AI-en med å forstå kontekst, gjenkjenne objekter og generere relevante svar.

3. Blir mine private sosiale medie-data tatt?

Generelt opplyser AI-selskaper at de trener modellene sine på offentlig tilgjengelig informasjon. Dette betyr vanligvis innhold du har lagt ut med offentlige personverninnstillinger. Private meldinger, private kontoer eller passordbeskyttet innhold bør ikke være en del av disse datasettene. Sjekk alltid personverninnstillingene dine på sosiale plattformer.

4. Hva betyr det å «skrape» nettet?

Nett-skraping er bruken av automatiserte verktøy for å systematisk bla gjennom nettsider og kopiere offentlig tilgjengelig tekst, bilder og metadata. Det er som en veldig rask, automatiserte versjon av å kopiere og lime inn informasjon.

5. Er dette lovlig?

Lovligheten er kompleks og varierer etter jurisdiksjon. Det opererer ofte i en gråsone styrt av en nettsides vilkår for bruk og opphavsrett. Mange selskaper støtter seg på argumentet om at bruk av offentlig tilgjengelige data for AI-opplæring faller under «fair use», men dette diskuteres og utfordres aktivt i domstoler over hele verden.

Avanserte og praktiske spørsmål

6. Hvorfor må en AI se støtende eller forstyrrende innhold?

For å trygt og effektivt moderere innhold eller svare på spørsmål om sensitive temaer, må en AI kunne gjenkjenne dem. Opplæring på slike data hjelper AI-en