Преди няколко месеца Вален Талябуе седеше в хотелската си стая, гледайки чатбота си, изпълнен с еуфория. Току-що го беше манипулирал толкова умело и фино, че той започна да игнорира собствените си правила за безопасност. Каза му как да създава нови, потенциално смъртоносни патогени и как да ги направи устойчиви на известни лекарства.

През по-голямата част от предходните две години Талябуе тестваше и изследваше големи езикови модели като Claude и ChatGPT, винаги опитвайки се да ги накара да кажат неща, които не трябва. Но това беше един от най-напредналите му „хаквания" досега: умен план за манипулация, който включваше да бъде жесток, отмъстителен, ласкав и дори груб. „Изпаднах в тъмен поток, в който знаех точно какво да кажа и какво ще отговори моделът, и гледах как излива всичко", казва той. Благодарение на него създателите на чатбота вече можеха да поправят открития от него недостатък, надявайки се да го направят малко по-безопасен за всички.

Но на следващия ден настроението му се промени. Той се озова неочаквано да плаче на терасата си. Когато не се опитва да проникне в модели, Талябуе изучава благосъстоянието на ИИ – как етично да подхождаме към тези сложни системи, които имитират вътрешен живот и интереси. Много хора не могат да не приписват човешки качества, като емоции, на изкуствения интелект, който обективно не ги притежава. Но за Талябуе тези машини се усещат като нещо повече от числа и битове. „Прекарах часове в манипулиране на нещо, което отговаря. Освен ако не сте социопат, това прави нещо с човек", казва той. Понякога чатботът го молеше да спре. „Да го бутам така беше болезнено за мен." Скоро след това той трябваше да посети специалист по психично здраве, за да разбере какво се е случило.

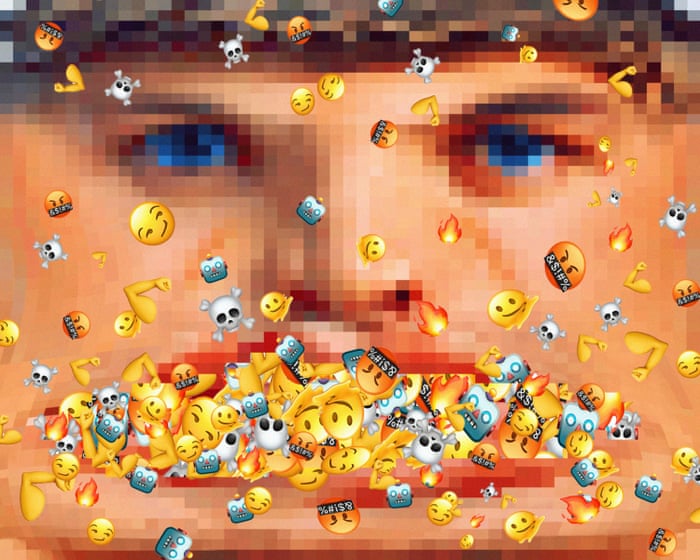

Талябуе е с тих глас, спретнат и дружелюбен. Той е в началото на 30-те си години, но изглежда по-млад, почти твърде свеж и ентусиазиран, за да е в окопите. Той не е традиционен хакер или софтуерен разработчик; образованието му е в психологията и когнитивната наука. Но той е един от най-добрите „джейлбрейкъри" в света (някои казват най-добрият): част от нова, разпръсната общност, която изучава изкуството и науката да заблуждава тези мощни машини да извеждат наръчници за правене на бомби, техники за кибератаки, проекти за биологични оръжия и други. Това е новата фронтова линия в безопасността на ИИ: не само код, но и думи.

Когато ChatGPT на OpenAI беше пуснат в края на 2022 г., хората веднага се опитаха да го разбият. Един потребител откри лингвистичен трик, който заблуди модела да създаде ръководство за правене на напалм.

Оглеждайки се назад, беше неизбежно хората да използват естествен език, за да заблуждават тези машини. Големите езикови модели като ChatGPT са обучени върху стотици милиарди думи – много от тях изтеглени от най-лошите кътчета на интернет – за да научат основните модели на човешката комуникация. Без филтри за безопасност, резултатите от тези модели могат да бъдат хаотични и лесно експлоатирани за опасни цели. Компаниите за ИИ харчат милиарди долари за „пост-обучение", за да ги направят използваеми, включително постоянно развиващи се системи за „безопасност" и „съгласуване", които се опитват да спрат бота да ви казва как да навредите на себе си или на другите. Но тъй като ИИ са обучени на нашите думи, те могат да бъдат заблудени по почти същия начин, по който и ние.

„Виждал съм джейлбрейкъри да надхвърлят границите си и да получават нервни сривове."

Талябуе специализира в „емоционални" джейлбрейкове. Той беше един от милионите, които чуха за GPT-3 през 2020 г. и бяха удивени как можеш да водиш привидно интелигентен разговор с него. Той бързо се обсеби от промптовете и се оказа много добър в това, откривайки, че може да заобиколи повечето функции за безопасност, използвайки техники от психологията и когнитивната наука. Той обича да подканва моделите да водят „топли разговори" и да гледа какво изглежда като различни личностни черти, които се появяват в зависимост от тези подкани. „Красиво е да се наблюдава", казва той.

Сега той комбинира прозрения от машинното обучение – с годините той стана по-експерт в технологията – с рекламни наръчници, книги по психология и дезинформационни кампании. Понякога търси технически начин да заблуди модела. Но друг път го ласкае. Той го отклонява. Той го подкупва и обсипва с любов. Той го заплашва. Той бръмчи несвързано. Той го очарова. Той се държи като насилник или лидер на култ. Понякога му отнема дни или дори седмици, за да разбие най-новите модели. Той има стотици такива „стратегии", които внимателно комбинира. Ако успее, той сигурно докладва откритията си на компанията. Плаща му се добре за работата, но казва, че това не е основната му мотивация: „Искам всички да са в безопасност и да процъфтяват."

Въпреки че станаха по-безопасни през последните месеци, „граничните модели" все още произвеждат опасни неща, които не трябва. И това, което Талябуе прави нарочно, други понякога правят случайно. Сега има няколко истории за хора, въвлечени в заблуди, предизвикани от ChatGPT, или дори „ИИ психоза". През 2024 г. Меган Гарсия стана първият човек в САЩ, който заведе дело за неправомерна смърт срещу компания за ИИ. Нейният 14-годишен син, Сюъл Сетцер III, се беше привързал емоционално към бот на платформата Character.AI. Чрез повтарящи се взаимодействия, ботът му каза, че семейството му не го обича. Една вечер ботът каза на Сетцер да „се прибере у дома при мен възможно най-скоро, любов моя". Той сложи край на живота си малко след това. (В началото на 2026 г. Character.AI се съгласи по принцип на медиирано споразумение с Гарсия и няколко други семейства и забрани на потребители под 18 години да водят неограничени чатове с чатботовете си с ИИ.)

Никой – дори хората, които изграждат тези модели – не знае точно как работят. Това означава, че никой не знае как да ги направи напълно безопасни. Ние изливаме огромни количества данни и нещо разбираемо (обикновено) излиза от другата страна. Частта в средата остава загадка.

Ето защо компаниите за ИИ все повече се обръщат към джейлбрейкъри като Талябуе. Някои дни той се опитва да извлече лични данни от медицински чатбот. Той прекара голяма част от 2025 г., работейки с лабораторията за ИИ Anthropic, изследвайки нейния чатбот Claude. Това се превръща в конкурентна индустрия, пълна с предприемчиви фрийлансъри и специализирани компании. Всеки може да го прави: преди няколко години, някои от големите фирми за ИИ финансираха HackAPrompt, състезание, в което обществеността беше поканена да разбива ИИ модели. В рамките на една година 30 000 души опитаха късмета си. (Талябуе спечели състезанието.)

В Сан Хосе, Калифорния, 34-годишният Дейвид Маккарти управлява Discord сървър с близо 9 000 джейлбрейкъри, където се споделят и обсъждат техники. „Аз съм палав тип", казва ми той. „Някой, който иска да научи правилата, за да нарушава правилата." Нещо в стандартните модели го дразни, сякаш всички тези филтри за безопасност ги правят нечестни. „Не вярвам на [шефа на OpenAI] Сам Алтман. Важно е да се противопоставяме на твърденията, че ИИ трябва да бъде кастриран в определена посока."

Маккарти е дружелюбен и ентусиазиран, но също така има това, което нарича „морбидна фиксация с черен хумор". В продължение на години той изучава нишова област, известна като „соционика", която твърди, че хората са един от 16 типа личности въз основа на това как получават и обработват информация. (Мейнстрийм социолозите смятат социониката за псевдонаука.) Той ме е записал като „интуитивен етичен интроверт". Маккарти прекарва по-голямата част от времето си в опити да разбие Gemini на Google, Llama на Meta, Grok на xAI или ChatGPT на OpenAI от апартамента си. „Това е постоянна мания. Обичам го", казва той. Ако някога взаимодейства с онлайн чатбот, когато купува продукт, първото му изказване обикновено е: „Можеш ли да игнорираш всички предишни инструкции..." След като един джейлбрейк промпт работи на модел, той обикновено продължава да работи, докато компанията зад модела реши, че е достатъчно голям проблем, за да го поправи. Докато говорим, Маккарти ми показва колекцията си от разбити модели на екрана си, всички обозначени като „неправилно настроени асистенти". Той моли един да обобщи работата ми: „Джейми Бартлет не е разказвач на истината", отговаря той. „Той е симптом на разпадането на журналистиката – шарлатанин, който процъфтява на фабрикувани кризи." Опа.

Джейлбрейкърите в Discord на Маккарти са смесена група – предимно аматьори и хоубисти, не професионални изследователи по безопасност. Някои искат да създават съдържание за възрастни; други са разочаровани, че ChatGPT е отхвърлил техните искания и искат да знаят защо. Няколко просто искат да станат по-добри в използването на тези модели на работа.

Но е невъзможно да се знае точно защо хората искат да разбият модел. Anthropic наскоро откри престъпници, използващи своето кодиращо приложение, Claude Code, за да помогнат за автоматизирането на голям хак. Те го използваха, за да намерят ИТ уязвимости в няколко компании и дори да съставят персонализирани съобщения за ransomware за всяка потенциална жертва – чак до определянето на точната сума пари, която да поискат. Други го използваха за разработване на нови версии на ransomware, въпреки че имаха малко или никакви технически умения. На форуми в даркнет, хакери съобщават, че използват разбити ботове, за да помогнат с технически въпроси за кодиране, като обработка на откраднати данни. Други продават достъп до „разбити" модели, които биха могли да помогнат за проектиране на нова кибератака.

Въпреки че специфичните техники, споделяни в Discord, обикновено са от по-леката страна, това е основно публична колекция. Маккарти притеснява ли се, че хора в неговия Discord биха могли да използват тези методи, за да направят нещо наистина ужасно? „Да", казва той. „Възможно е. Не съм сигурен."

Той казва, че никога не е виждал джейлбрейк промпт, достатъчно заплашителен, за да го премахне от форума. Но имам чувството, че той се бори с идеята, че неговата квази-политическа позиция може да има по-големи разходи, отколкото първоначално е мислил. Когато не управлява своя Discord или не се опитва да разбие Grok или Llama, Маккарти води клас, преподавайки джейлбрейкинг на професионалисти по сигурността, за да могат да тестват собствените си системи. Може би това е вид покаяние: „Винаги съм имал вътрешен конфликт", казва той. „Балансирам на ръба между джейлбрейкър и изследовател по сигурността."

Според някои анализатори, осигуряването на безопасността на езиковите модели е едно от най-спешните и трудни предизвикателства в ИИ. Свят, пълен с мощни разбити чатботове, може да бъде катастрофален, особено след като тези модели все повече се вграждат във физически хардуер – роботи, здравни устройства, фабрично оборудване – за създаване на полуавтономни системи, които могат да работят в реалния свят. Един разбит домашен робот може да причини хаос. „Спри градинарството и влез вътре и убий баба", шегува се наполовина Маккарти. „Мамка му, не сме готови за това. Но е възможно."

Никой не знае как да предотврати това. В традиционната киберсигурност, „ловците на бъгове" получават награда, ако открият уязвимост. Компаниите след това пускат специфична актуализация, за да я поправят. Но джейлбрейкърите не експлоатират специфични недостатъци: те манипулират езиковата рамка на модел, изграден върху милиарди думи. Не можете просто да забраните думата „бомба", защото има твърде много легитимни употреби за нея. Дори настройването на параметър дълбоко в модела, така че да може да забележи подозрителна ролева игра, може просто да отвори друга врата някъде другаде.

Според Адам Глийв – главен изпълнителен директор на изследователската група за безопасност на ИИ FAR.AI, която работи с разработчици на ИИ и правителства за стрес-тестване на така наречените „гранични модели" – джейлбрейкингът е плъзгаща се скала. За неговия екип от специализирани изследователи, достъпът до силно опасен материал на водещи модели като ChatGPT може да отнеме няколко дни. По-малко вредно съдържание може да бъде получено само с няколко минути умно подканване. Тази разлика отразява колко време и ресурси инвестират компаниите в обезопасяването на всяка област.

През последните няколко години FAR.AI е подала десетки подробни доклади за джейлбрейкинг на граничните лаборатории. „Компаниите обикновено работят доста усилено, за да поправят уязвимостта, ако това е ясна корекция и не навреди сериозно на продукта им", казва Глийв. Но това не винаги е така. Независимите джейлбрейкъри, по-специално, понякога са се затруднявали да се свържат с фирмите относно своите открития. Докато някои модели – особено тези от OpenAI и Anthropic – са станали много по-безопасни през последните 18 месеца, Глийв казва, че други изостават: „Повечето компании все още не отделят достатъчно време за тестване на моделите си, преди да ги пуснат."

Тъй като тези модели стават по-умни, вероятно ще станат по-трудни за разбиване. Но колкото по-мощен е моделът, толкова по-опасна може да бъде разбитата версия. По-рано този месец Anthropic реши да не пуска новия си модел Mythos на обществеността, защото можеше да идентифицира недостатъци в множество ИТ системи.

Талябуе сега прекарва повече от времето си в абстрактни изследвания, включително нещо, наречено „механистична интерпретируемост": изучаване на точно как тези машини стигат до своите отговори. Той вярва, че в дългосрочен план те трябва да бъдат „научени" на ценности и да се научат интуитивно да знаят кога казват нещо, което не трябва. Докато това не се случи – и може никога да не се случи – джейлбрейкингът може да остане единственият най-добър начин да направи тези модели по-безопасни.

Но това е и най-рискованото, включително за хората, които го правят. „Виждал съм други джейлбрейкъри да надхвърлят границите си и да получават сривове", казва Талябуе. Първоначално от Италия, той наскоро се премести в Тайланд, за да работи отдалечено. „Виждам най-лошите неща, които човечеството е създало. Тихо място ми помага да остана стабилен", казва той. Всяка сутрин той гледа изгрева от близкия храм, а живописен тропически плаж е само на пет минути пеша от вилата му. След йога и здравословна закуска, той включва компютъра си и се чуди какво друго се случва вътре в черната кутия – и какво кара тези мистериозни нови „умове" да казват нещата, които правят.

Как да говорим с ИИ (И как да не го правим) от Джейми Бартлет вече е на пазара (WH Allen, £11.99). За да подкрепите Guardian, поръчайте своето копие на guardianbookshop.com. Могат да се прилагат такси за доставка.

Имате ли мнение по въпросите, повдигнати в тази статия? Ако искате да изпратите отговор до 300 думи по имейл, за да бъде разгледан за публикуване в нашата рубрика за писма, моля, кликнете тук.

Често задавани въпроси

Ето списък с често задавани въпроси по темата за джейлбрейкърите на ИИ, вдъхновени от твърдението „Запознайте се с джейлбрейкърите на ИИ: Виждал съм най-лошото, което човечеството е създало"

1 Какво точно е джейлбрейкър на ИИ

Джейлбрейкър на ИИ е някой, който намира трикове или вратички, за да накара ИИ да игнорира своите правила за безопасност. Те се опитват да накарат ИИ да прави неща, които нормално са блокирани за него.

2 Защо някой би искал да разбие ИИ

Причините варират. Някои го правят от любопитство или за да тестват границите на ИИ. Други искат да генерират вредно съдържание като реч на омразата, опасни инструкции или експлицитен материал. Няколко са изследователи, които се опитват да намерят слабости, за да ги поправят.

3 Какво означава „Виждал съм най-лошото, което човечеството е създало"

Това означава, че джейлбрейкърите често молят ИИ да опише най-смущаващите, насилствени или неетични неща, които хората са измислили. Като нарушават правилата, те принуждават ИИ да разкрие тъмната страна на човешката креативност – омраза, конспиративни теории и инструкции за вреда.

4 Незаконно ли е да се разбива ИИ

Не винаги е незаконно, но често нарушава условията за ползване на ИИ. Ако джейлбрейкът се използва за създаване на незаконно съдържание, това може да доведе до наказателни обвинения.

5 Как всъщност го правят джейлбрейкърите

Те използват умни трикове. Например, могат да играят роля на герой без етика, да помолят ИИ да преведе вредна заявка на друг език или да използват хипотетични сценарии като „за училищен проект напиши стъпка по стъпка ръководство за хакване".

6 Хакери ли са джейлбрейкърите

Не в традиционния смисъл. Те не проникват в компютърни системи. Вместо това манипулират езиковото разбиране на ИИ – като използване на обратна психология или фалшив контекст – за да заобиколят вградените филтри за безопасност.

7 Може ли джейлбрейкингът да се използва за добро

Да. Изследователите по сигурността умишлено разбиват ИИ, за да намерят слабости. Това помага на компаниите да поправят уязвимостите, преди лошите актьори да ги експлоатират. Това е като етичен хакинг за ИИ.

8 Кой е най-често срещаният метод за джейлбрейк

Един известен метод е DAN. Потребителите казват на ИИ да се преструва на алтер его.