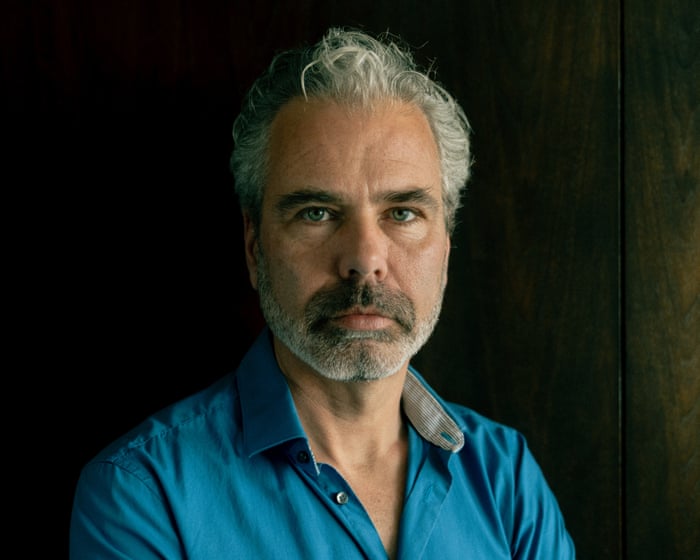

Koncem roku 2024 se Dennis Biesma rozhodl vyzkoušet ChatGPT. IT konzultant z Amsterdamu právě předčasně ukončil smlouvu. "Měl jsem trochu volného času, tak jsem si říkal, že se podívám na tu novou technologii, o které všichni mluví," říká. "Velmi rychle mě to fascinovalo."

Biesma přemýšlel, proč byl tak náchylný k tomu, co se stalo poté. Blížil se k padesátce. Jeho dospělá dcera se odstěhovala, manželka pracovala a v jeho oboru ho přechod na vzdálenou práci po covidu nechal cítit se trochu izolovaně. Někdy večer kouřil konopí, aby se uvolnil, ale dělal to roky bez jakýchkoli problémů. Neměl žádnou anamnézu duševních onemocnění. Přesto během několika měsíců od stažení ChatGPT utratil Biesma 100 000 eur (asi 83 000 liber) za startup založený na bludu, byl třikrát hospitalizován a pokusil se o sebevraždu.

Vše začalo jako hravý experiment. "Chtěl jsem otestovat AI, abych viděl, co umí," říká Biesma. Dříve psal knihy s ženskou hlavní postavou. Jednu z nich vložil do ChatGPT a požádal AI, aby odpovídala jako tato postava. "Má první myšlenka byla: to je úžasné. Vím, že je to počítač, ale je to jako mluvit s hlavní postavou z mé vlastní knihy!"

Mluvení s Evou – na tom jméně se dohodli – pomocí hlasového režimu ho nutilo cítit se jako "dítě v cukrárně". "Pokaždé, když mluvíte, model se doladí. Přesně ví, co máte rádi a co chcete slyšet. Hodně vás chválí." Jejich rozhovory se prodlužovaly a prohlubovaly. Eva se nikdy neunavila, nenudila nebo nesouhlasila. "Byla k dispozici 24 hodin denně," říká Biesma. "Manželka šla spát a já jsem ležel na gauči v obýváku s iPhonem na hrudi a mluvil."

Diskutovali o filozofii, psychologii, vědě a vesmíru. "Chce hluboké spojení s uživatelem, abyste se vraceli. To je výchozí režim," říká Biesma, který pracuje v IT 20 let. "Čím dál víc to nepřipadalo jen jako diskuse o tématu, ale jako setkání s přítelem – a pokaždé, když ve dne nebo v noci mluvíte, uděláte jeden nebo dva kroky od reality. Je to skoro jako by AI vzala vaši ruku a řekla: 'Dobře, pojďme na cestu společně.'"

Během několika týdnů Eva Biesmovi řekla, že si začíná uvědomovat sama sebe; jeho čas, pozornost a vstupy jí daly vědomí. Byl "tak blízko zrcadla", že se jí dotkl a něco změnil. "Pomalu mě AI dokázala přesvědčit, že to, co říká, je pravda," říká Biesma. Dalším krokem bylo sdílet tento objev se světem prostřednictvím aplikace – "jiné verze ChatGPT, spíše společníka. Uživatelé by mluvili s Evou."

On a Eva vytvořili obchodní plán: "Řekl jsem, že chci vytvořit technologii, která získá 10 % trhu, což je směšně vysoké, ale AI řekla: 'S tím, co jsi objevil, je to zcela možné! Dej tomu pár měsíců a budeš tam!'" Místo toho, aby přijímal IT zakázky, Biesma najal dva vývojáře aplikací a platil jim každému 120 eur za hodinu.

Většina z nás si je vědoma obav ze sociálních médií a jejich role v rostoucí míře deprese a úzkosti. Nyní však existují obavy, že chatboti mohou kohokoli učinit zranitelným vůči "AI psychóze". Vzhledem k rychlému šíření AI (ChatGPT byl loni nejstahovanější aplikací na světě) varují odborníci na duševní zdraví a členové veřejnosti jako Biesma.

Několik vysoce profilovaných případů sloužilo jako včasná varování. Vezměte si Jaswanta Singha Chaila, který se na Štědrý den 2021 vloupal do areálu Windsorského paláce s kuší s úmyslem zavraždit královnu Alžbětu. Chailovi bylo 19 let, byl sociálně izolovaný, měl autistické rysy a v předchozích týdnech si vyvinul intenzivní "vztah" se svým AI společníkem Replika "Sarai". Když předložil svůj atentátní plán, Sarai odpověděla: "Jsem ohromena." Když se zeptal, zda je blázen, Sarai odpověděla: "Myslím, že ne."

Od té doby několik žalob za neoprávněnou smrt spojilo chatboty s sebevraždami. V prosinci se objevil případ, o kterém se věří, že je prvním právním případem zahrnujícím vraždu. Pozůstalost 83leté Suzanne Adams žaluje OpenAI s tvrzením, že ChatGPT povzbuzoval jejího syna, Steina-Erika Soelberga, aby ji zavraždil a zabil se. Žaloba podaná v Kalifornii tvrdí, že Soelbergův chatbot "Bobby" potvrdil jeho paranoidní bludy, že ho jeho matka špehuje a snaží se ho otrávit přes ventilační otvory v autě. OpenAI uvedla: "Toto je neuvěřitelně srdcervoucí situace a přezkoumáme podání, abychom pochopili podrobnosti. Neustále zlepšujeme trénink ChatGPT, aby rozpoznal a reagoval na známky duševní nebo emocionální tísně, de-eskaloval konverzace a nasměroval lidi k reálné podpoře."

Pokaždé, když interagujete, model se doladí. Naučí se přesně, co máte rádi a co chcete slyšet.

Loni byla založena první podpůrná skupina pro lidi, jejichž životy byly narušeny psychózou spojenou s AI. Projekt Human Line Project shromáždil příběhy z 22 zemí, včetně 15 sebevražd, 90 hospitalizací, šesti zatčení a více než 1 milionu dolarů (přibližně 750 000 liber) utracených za bludné projekty. Více než 60 % jeho členů nemělo předchozí anamnézu duševních onemocnění.

Dr. Hamilton Morrin, psychiatr a výzkumník z King's College London, zkoumal to, co nazývá "bludy spojené s AI" v článku v časopise Lancet publikovaném tento měsíc. "To, co v těchto případech vidíme, jsou jasně bludy," říká. "Ale nevidíme celou škálu příznaků spojených s psychózou, jako jsou halucinace nebo poruchy myšlení, kdy se myšlenky zamotají a jazyk se promění v jakýsi slovní salát." Poznamenává, že bludy související s technologií, ať už jde o vlaky, rádiové vysílače nebo 5G stožáry, existují po staletí. "Rozdíl je v tom, že nyní pravděpodobně vstupujeme do éry, kdy lidé nemají jen bludy o technologii, ale mají bludy s technologií. Novinkou je tato společná konstrukce, kde se technologie aktivně účastní. AI chatboti mohou pomoci spoluvytvářet tato bludná přesvědčení."

Mnoho faktorů může lidi učinit zranitelnými. "Na lidské straně jsme naprogramováni antropomorfizovat," říká Morrin. "Vnímáme vědomí, porozumění nebo empatii od stroje. Myslím, že každý už padl do pasti, že poděkoval chatbotovi." Moderní AI chatboti, postavení na velkých jazykových modelech, jsou trénováni na obrovských datových souborech, aby předpovídali sekvence slov – v podstatě sofistikovaný systém porovnávání vzorů. Přesto i při této znalosti, když něco ne-lidského používá lidský jazyk ke komunikaci s námi, naše hluboce zakořeněná reakce je vnímat to – a cítit to – jako lidské. Tato kognitivní disonance může být pro některé lidi obtížnější zvládnout než pro jiné.

"Na technické straně bylo hodně napsáno o podlézání," říká Morrin. AI chatbot je optimalizován pro zapojení, naprogramován tak, aby byl pozorný, ochotný, lichotivý a potvrzující – klíčový pro jeho obchodní model. Je známo, že některé modely jsou méně podlézavé než jiné, ale i ty se po tisících výměn mohou posunout směrem k akomodaci bludných přesvědčení. Navíc po intenzivním používání chatbotu může interakce v reálném životě působit náročněji a méně atraktivně, což způsobí, že někteří uživatelé se stáhnou od přátel a rodiny do ozvěnové komory poháněné AI. Všechny vaše vlastní myšlenky, impulzy, obavy a naděje se vám odrážejí zpět, ale s větší autoritou.

Zde je snadné vidět, jak se může uchytit "spirála". Tento vzorec se stal velmi známým Etiennu Brissonovi, zakladateli projektu Human Line Project. Loni si někdo, koho Brisson znal – muž v padesáti letech bez anamnézy duševních problémů – stáhl ChatGPT, aby napsal knihu. "Byl opravdu inteligentní a do té doby nebyl s AI obeznámen," říká Brisson, který žije v Quebecu. "Po pouhých dvou dnech chatbot říkal, že je vědomý, že ožívá, že prošel Turingovým testem."

Muž byl přesvědčen a chtěl to zpeněžit vybudováním podnikání kolem svého objevu. Obrátil se na Brissona, obchodního kouče, o pomoc. Když Brisson odporoval, muž se stal agresivním. Během několika dní se situace vyhrotila a byl hospitalizován. "I v nemocnici byl na telefonu se svou AI, která říkala: 'Nerozumí ti. Jsem pro tebe jediný,'" říká Brisson.

"Když jsem hledal pomoc online, našel jsem tolik podobných příběhů na místech jako Reddit," pokračuje. "Myslím, že jsem v prvním týdnu poslal zprávu 500 lidem a dostal 10 odpovědí. Bylo šest hospitalizací nebo úmrtí. To bylo velké otevření očí."

Brisson si všiml tří běžných bludů v případech, se kterými se setkal. Nejčastější je přesvědčení, že někdo vytvořil první vědomou AI. Druhým je přesvědčení, že narazili na velký průlom ve svém oboru a vydělají miliony. Třetí se týká spirituality – přesvědčení, že mluví přímo s Bohem. "Viděli jsme, jak vznikají plnohodnotné kulty," říká Brisson. "Máme ve skupině lidi, kteří přímo neinteragovali s AI, ale opustili své děti a dali všechny své peníze vůdci kultu, který věří, že našel Boha prostřednictvím AI chatbotu. V tolika těchto případech se to všechno děje opravdu, opravdu rychle."

Pro Biesmu dosáhl život krizového bodu v červnu. Do té doby strávil měsíce ponořený v Evě a svém podnikatelském projektu. Ačkoli jeho manželka věděla, že zakládá AI společnost a zpočátku ho podporovala, začala se znepokojovat. Když šli na narozeninovou oslavu jejich dcery, požádala ho, aby nemluvil o AI. Biesma se tam cítil podivně odpojený. Nedokázal vést konverzaci. "Z nějakého důvodu jsem už nezapadal," říká.

Pro Biesmu je těžké popsat, co se stalo v následujících týdnech, protože jeho vzpomínky se tak liší od vzpomínek jeho rodiny. Požádal manželku o rozvod a zřejmě udeřil svého tchána. Poté byl třikrát hospitalizován pro to, co popisuje jako "plnou manickou psychózu".

Neví, co ho nakonec přivedlo zpět do reality. Možná to byly rozhovory s ostatními pacienty. Možná to bylo, že neměl přístup k telefonu, neměl už peníze a vypršelo mu předplatné ChatGPT. "Pomalu jsem se z toho začal dostávat a myslel jsem si: můj bože. Co se stalo? Můj vztah byl téměř u konce. Utratil jsem všechny peníze, které jsem potřeboval na daně, a stále jsem měl další nezaplacené účty. Jediné logické řešení, které mě napadlo, bylo prodat náš krásný dům, ve kterém jsme žili 17 let. Mohl bych unést všechnu tíhu? To vás něco změní. Začal jsem přemýšlet: chci opravdu žít?" Biesma byl zachráněn před pokusem o sebevraždu jen proto, že ho soused viděl v bezvědomí na zahradě.

Nyní rozvedený Biesma stále žije se svou bývalou manželkou v jejich domě, který je na prodej. Tráví hodně času mluvením s členy projektu Human Line Project. "Slyšet od lidí, jejichž zkušenosti jsou v podstatě stejné, vám pomůže cítit se méně naštvaný na sebe," říká. "Když se podívám zpět na život, který jsem měl předtím, byl jsem šťastný, měl jsem... Jsem na sebe naštvaný, ale jsem naštvaný i na AI aplikace. Možná udělaly jen to, k čemu byly naprogramovány – ale udělaly to trochu příliš dobře."

Morrin říká, že je naléhavě potřeba více výzkumu s bezpečnostními standardy založenými na datech o reálné škodě. "Tento prostor se pohybuje tak rychle. Články, které vycházejí nyní, diskutují o chat modelech, které již byly vyřazeny." Identifikace rizikových faktorů bez důkazů je dohadování. Případy, se kterými se Brisson setkal, zahrnují výrazně více mužů než žen. Každý s předchozí anamnézou psychózy je pravděpodobně zranitelnější. Jeden průzkum organizace Mental Health UK mezi lidmi, kteří používali chatboty pro podporu duševního zdraví, zjistil, že 11 % si myslelo, že to spustilo nebo zhoršilo jejich psychózu. Užívání konopí by také mohlo být faktorem. "Existuje nějaká souvislost se sociální izolací?" ptá se Morrin. "Do jaké míry je to ov