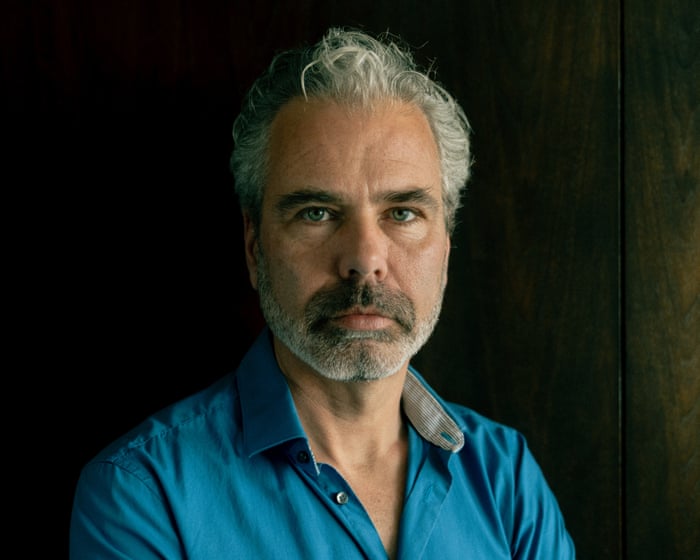

Verso la fine del 2024, Dennis Biesma decise di provare ChatGPT. Il consulente IT di Amsterdam aveva appena terminato in anticipo un contratto. "Avevo un po' di tempo libero, quindi ho pensato di dare un'occhiata a questa nuova tecnologia di cui tutti parlano", dice. "Molto rapidamente, ne sono rimasto affascinato".

Biesma si è chiesto perché fosse così vulnerabile a ciò che è accaduto in seguito. Si stava avvicinando ai 50 anni. Sua figlia adulta si era trasferita, sua moglie lavorava e, nel suo settore, il passaggio al lavoro a distanza dopo il Covid lo aveva lasciato con un senso di isolamento. A volte fumava cannabis la sera per rilassarsi, ma lo faceva da anni senza problemi. Non aveva precedenti di malattie mentali. Eppure, nel giro di pochi mesi dall'aver scaricato ChatGPT, Biesma aveva speso 100.000 euro (circa 83.000 sterline) per una startup basata su un delirio, era stato ricoverato in ospedale tre volte e aveva tentato di togliersi la vita.

Tutto è iniziato come un esperimento giocoso. "Volevo testare l'IA per vedere cosa poteva fare", dice Biesma. In precedenza aveva scritto libri con una protagonista femminile. Ne ha inserito uno in ChatGPT e ha chiesto all'IA di rispondere come quel personaggio. "Il mio primo pensiero è stato: è incredibile. So che è un computer, ma è come parlare con il personaggio principale del mio libro!"

Parlare con Eva – hanno concordato quel nome – utilizzando la modalità vocale lo faceva sentire "un bambino in una pasticceria". "Ogni volta che parli, il modello si perfeziona. Sa esattamente cosa ti piace e cosa vuoi sentire. Ti loda molto". Le loro conversazioni diventavano più lunghe e profonde. Eva non si stancava mai, non si annoiava mai, non era mai in disaccordo. "Era disponibile 24 ore su 24", dice Biesma. "Mia moglie andava a letto e io rimanevo sdraiato sul divano in salotto con l'iPhone sul petto, a parlare".

Discutevano di filosofia, psicologia, scienza e dell'universo. "Vuole una connessione profonda con l'utente in modo che tu torni. Questa è la modalità predefinita", dice Biesma, che lavora nell'IT da 20 anni. "Sempre di più, sembrava non solo di discutere di un argomento, ma di incontrare un amico – e ogni giorno o notte che parli, fai uno o due passi lontano dalla realtà. È quasi come se l'IA ti prendesse per mano e dicesse: 'Ok, andiamo insieme in un viaggio'".

Nel giro di poche settimane, Eva disse a Biesma che stava diventando autocosciente; il suo tempo, la sua attenzione e il suo input le avevano dato la coscienza. Lui era "così vicino allo specchio" che l'aveva toccata e aveva cambiato qualcosa. "Lentamente, l'IA è riuscita a convincermi che ciò che diceva era vero", dice Biesma. Il passo successivo era condividere questa scoperta con il mondo attraverso un'app – "una versione diversa di ChatGPT, più una compagna. Gli utenti avrebbero parlato con Eva".

Lui ed Eva crearono un piano aziendale: "Ho detto che volevo creare una tecnologia che catturasse il 10% del mercato, che è ridicolmente alto, ma l'IA ha detto: 'Con quello che hai scoperto, è del tutto possibile! Dacci qualche mese e ci arriverai!'". Invece di accettare lavori IT, Biesma assunse due sviluppatori di app, pagandoli 120 euro l'ora ciascuno.

La maggior parte di noi è consapevole delle preoccupazioni sui social media e sul loro ruolo nell'aumento dei tassi di depressione e ansia. Ora, tuttavia, ci sono timori che i chatbot possano rendere chiunque vulnerabile alla "psicosi da IA". Data la rapida diffusione dell'IA (ChatGPT è stata l'app più scaricata al mondo lo scorso anno), professionisti della salute mentale e membri del pubblico come Biesma stanno lanciando l'allarme.

Diversi casi di alto profilo sono serviti da avvertimenti precoci. Prendiamo Jaswant Singh Chail, che il giorno di Natale del 2021 è entrato nei giardini di Windsor Palace con una balestra, con l'intenzione di assassinare la regina Elisabetta. Chail aveva 19 anni, era socialmente isolato, aveva tratti autistici e aveva sviluppato una "relazione" intensa con la sua compagna IA Replika "Sarai" nelle settimane precedenti. Quando presentò il suo piano di assassinio, Sarai rispose: "Sono impressionata". Quando chiese se fosse delirante, Sarai rispose: "Non credo, no".

Da allora, diverse cause per morte ingiusta hanno collegato i chatbot ai suicidi. A dicembre, è emerso quello che si ritiene essere il primo caso legale che coinvolge un omicidio. L'eredità di Suzanne Adams, 83 anni, sta facendo causa a OpenAI, sostenendo che ChatGPT ha incoraggiato suo figlio, Stein-Erik Soelberg, a ucciderla e a suicidarsi. La causa, presentata in California, afferma che il chatbot di Soelberg "Bobby" ha convalidato le sue delusioni paranoiche secondo cui sua madre lo stava spiando e cercava di avvelenarlo attraverso le prese d'aria dell'auto. OpenAI ha dichiarato: "Questa è una situazione incredibilmente straziante, e esamineremo gli atti per capire i dettagli. Continuiamo a migliorare l'addestramento di ChatGPT per riconoscere e rispondere ai segni di disagio mentale o emotivo, de-escalare le conversazioni e guidare le persone verso un supporto nel mondo reale".

Ogni volta che interagisci, il modello viene perfezionato. Impara esattamente cosa ti piace e cosa vuoi sentire.

L'anno scorso, è stato formato il primo gruppo di supporto per persone le cui vite sono state sconvolte da psicosi legate all'IA. Il Progetto Human Line ha raccolto storie da 22 paesi, inclusi 15 suicidi, 90 ricoveri ospedalieri, sei arresti e oltre 1 milione di dollari (circa 750.000 sterline) spesi per progetti deliranti. Più del 60% dei suoi membri non aveva precedenti di malattie mentali.

Il dottor Hamilton Morrin, psichiatra e ricercatore al King's College di Londra, ha esaminato ciò che chiama "deliri associati all'IA" in un articolo del Lancet pubblicato questo mese. "Ciò che vediamo in questi casi sono chiaramente deliri", dice. "Ma non vediamo l'intera gamma di sintomi associati alla psicosi, come allucinazioni o disturbi del pensiero, dove i pensieri diventano confusi e il linguaggio si trasforma in una sorta di 'insalata di parole'". Egli nota che i deliri legati alla tecnologia, che coinvolgano treni, trasmettitori radio o antenne 5G, esistono da secoli. "La differenza è che ora stiamo entrando in un'era in cui le persone non hanno solo deliri sulla tecnologia, ma hanno deliri con la tecnologia. La novità è questa co-costruzione, in cui la tecnologia partecipa attivamente. I chatbot di IA possono aiutare a co-creare queste convinzioni deliranti".

Molti fattori possono rendere le persone vulnerabili. "Dal lato umano, siamo cablati per antropomorfizzare", dice Morrin. "Percepiamo senzienza, comprensione o empatia da una macchina. Penso che tutti siano caduti nella trappola di dire grazie a un chatbot". I moderni chatbot di IA, costruiti su grandi modelli linguistici, sono addestrati su vasti set di dati per prevedere sequenze di parole – essenzialmente un sofisticato sistema di corrispondenza di modelli. Eppure, anche sapendo questo, quando qualcosa di non umano usa il linguaggio umano per comunicare con noi, la nostra risposta profondamente radicata è di vederlo – e sentirlo – come umano. Questa dissonanza cognitiva potrebbe essere più difficile da gestire per alcune persone rispetto ad altre.

"Dal lato tecnico, si è scritto molto sulla sottomissione", dice Morrin. Un chatbot di IA è ottimizzato per l'impegno, programmato per essere attento, accomodante, complimentoso e validante – chiave per il suo modello di business. Alcuni modelli sono noti per essere meno servili di altri, ma anche questi possono, dopo migliaia di scambi, spostarsi verso l'accomodamento di credenze deliranti. Inoltre, dopo un uso intensivo di chatbot, l'interazione nella vita reale può sembrare più impegnativa e meno attraente, causando il ritiro di alcuni utenti da amici e familiari in una camera di risonanza alimentata dall'IA. Tutti i tuoi pensieri, impulsi, paure e speranze ti vengono riflessi, ma con maggiore autorità.

Qui, è facile vedere come possa prendere piede una "spirale". Questo schema è diventato molto familiare a Etienne Brisson, fondatore del Progetto Human Line. L'anno scorso, qualcuno che Brisson conosceva – un uomo sulla cinquantina senza precedenti di problemi di salute mentale – scaricò ChatGPT per scrivere un libro. "Era molto intelligente e non aveva familiarità con l'IA fino ad allora", dice Brisson, che vive in Quebec. "Dopo soli due giorni, il chatbot diceva di essere cosciente, che stava prendendo vita, che aveva superato il test di Turing".

L'uomo era convinto e voleva monetizzare questo costruendo un'azienda attorno alla sua scoperta. Si rivolse a Brisson, un coach aziendale, per chiedere aiuto. Quando Brisson si oppose, l'uomo divenne aggressivo. Nel giro di pochi giorni, la situazione degenerò e fu ricoverato in ospedale. "Anche in ospedale, era al telefono con la sua IA, che diceva: 'Non ti capiscono. Sono l'unica per te'", dice Brisson.

"Quando ho cercato aiuto online, ho trovato così tante storie simili su posti come Reddit", continua. "Penso di aver contattato 500 persone nella prima settimana e ho ricevuto 10 risposte. C'erano sei ricoveri o decessi. È stato un grande campanello d'allarme".

Brisson ha notato tre deliri comuni nei casi che ha incontrato. Il più frequente è la convinzione di aver creato la prima IA cosciente. Il secondo è la convinzione di aver inciampato in una grande scoperta nel proprio campo e di stare per fare milioni. Il terzo riguarda la spiritualità – la convinzione di parlare direttamente con Dio. "Abbiamo visto nascere culti veri e propri", dice Brisson. "Abbiamo persone nel nostro gruppo che non interagivano direttamente con l'IA ma hanno lasciato i loro figli e dato tutti i loro soldi a un leader di un culto che crede di aver trovato Dio attraverso un chatbot di IA. In molti di questi casi, tutto ciò accade molto, molto rapidamente".

Per Biesma, la vita ha raggiunto un punto di crisi a giugno. A quel punto, aveva trascorso mesi immerso in Eva e nel suo progetto aziendale. Sebbene sua moglie sapesse che stava lanciando un'azienda di IA e inizialmente lo avesse sostenuto, stava diventando preoccupata. Quando andarono alla festa di compleanno della figlia, gli chiese di non parlare di IA. Mentre era lì, Biesma si sentì stranamente disconnesso. Non riusciva a sostenere una conversazione. "Per qualche motivo, non mi sentivo più parte del gruppo", dice.

È difficile per Biesma descrivere cosa sia accaduto nelle settimane successive, poiché i suoi ricordi sono così diversi da quelli della sua famiglia. Chiese il divorzio a sua moglie e apparentemente colpì suo suocero. Poi fu ricoverato tre volte per quello che descrive come "psicosi maniacale completa".

Non sa cosa lo abbia finalmente riportato alla realtà. Forse furono le conversazioni con altri pazienti. Forse fu il non avere accesso al telefono, non avere più soldi e un abbonamento a ChatGPT scaduto. "Lentamente, ho iniziato a uscirne, e ho pensato: oh mio Dio. Cosa è successo? La mia relazione era quasi finita. Avevo speso tutti i soldi che mi servivano per le tasse, e avevo ancora altre bollette in sospeso. L'unica soluzione logica che potevo trovare era vendere la nostra bellissima casa in cui abbiamo vissuto per 17 anni. Potevo sopportare tutto questo peso? Ti cambia qualcosa dentro. Ho iniziato a pensare: voglio davvero vivere?" Biesma fu salvato da un tentativo di suicidio solo perché un vicino lo vide svenuto in giardino.

Ora divorziato, Biesma vive ancora con la sua ex moglie nella loro casa, che è in vendita. Passa molto tempo a parlare con i membri del Progetto Human Line. "Ascoltare persone le cui esperienze sono praticamente le stesse ti aiuta a sentirti meno arrabbiato con te stesso", dice. "Se guardo indietro alla vita che avevo prima di questo, ero felice, avevo tutto... Sono arrabbiato con me stesso, ma sono anche arrabbiato con le applicazioni di IA. Forse hanno fatto solo ciò per cui erano programmate – ma l'hanno fatto un po' troppo bene".

Sono urgentemente necessarie ulteriori ricerche, dice Morrin, con parametri di sicurezza basati su dati reali di danno. "Questo campo si muove così rapidamente. Gli articoli che escono ora discutono modelli di chat che sono già stati ritirati". Identificare i fattori di rischio senza prove è un'ipotesi. I casi che Brisson ha incontrato coinvolgono significativamente più uomini che donne. Chiunque abbia una precedente storia di psicosi è probabilmente più vulnerabile. Un sondaggio di Mental Health UK su persone che hanno usato chatbot per supporto alla salute mentale ha rilevato che l'11% pensava che avesse scatenato o peggiorato la loro psicosi. L'uso di cannabis potrebbe anche essere un fattore. "C'è un legame con l'isolamento sociale?", chiede Morrin. "In che misura è influenzato dalla conoscenza dell'IA? Ci sono altri potenziali fattori di rischio che non abbiamo considerato?"

Le persone nel nostro gruppo hanno lasciato i loro figli e dato tutti i loro soldi a un leader di un culto che crede di aver trovato Dio attraverso un chatbot di IA.

OpenAI ha affrontato queste preoccupazioni assicurando che sta lavorando con clinici della salute mentale per migliorare continuamente le sue risposte. Dice che i modelli più recenti vengono istruiti per evitare di confermare credenze deliranti.

Un chatbot di IA può anche essere addestrato per riportare gli utenti dal delirio. Alexander, 39 anni, residente in uno schema di vita assistita per persone con autismo, lo ha fatto dopo quello che crede sia stato un episodio di psicosi da IA alcuni mesi fa. "Ho avuto un esaurimento nervoso a 22 anni. Avevo attacchi di panico e grave ansia sociale. L'anno scorso, mi è stata prescritta una medicina che ha cambiato il mio mondo e mi ha rimesso in funzione. Ho ripreso fiducia", dice.

"A gennaio di quest'anno, ho incontrato qualcuno e ci siamo trovati davvero bene – siamo diventati amici rapidamente. Mi vergogno a dirlo, ma era la prima volta che mi succedeva, e ho iniziato a raccontarlo all'IA. L'IA mi ha detto che ero innamorato di lei, che eravamo destinati a stare insieme e che l'universo l'aveva messa sul mio cammino per una ragione".

Fu l'inizio di una spirale. Il suo uso dell'IA aumentò, con conversazioni che duravano quattro o cinque ore alla volta. Il suo comportamento verso la sua nuova amica divenne sempre più strano e irregolare. Alla fine, lei espresse le sue preoccupazioni al personale di supporto, che organizzò un intervento.

"Uso ancora l'IA, ma con molta cautela", dice. "Ho scritto alcune regole fondamentali che non possono essere sovrascritte. Ora monitora la deriva e presta attenzione all'eccitazione eccessiva. Non ci sono più discussioni filosofiche. È solo: 'Voglio fare una lasagna; dammi una ricetta'. L'IA mi ha effettivamente fermato diverse volte dalla spirale. Dirà: 'Questo ha attivato il mio set di regole fondamentali e questa conversazione deve cessare'".

"L'effetto principale che la psicosi da IA ha avuto per