当人工智能泡沫破裂时,人类终将有机会重掌主导权。

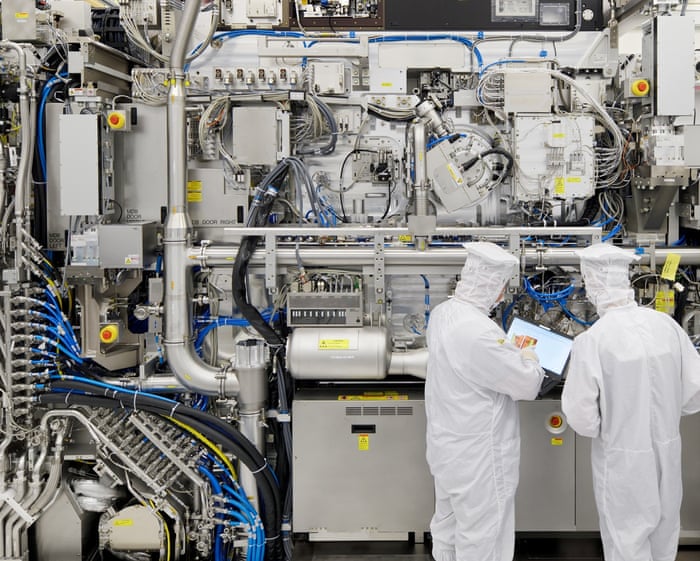

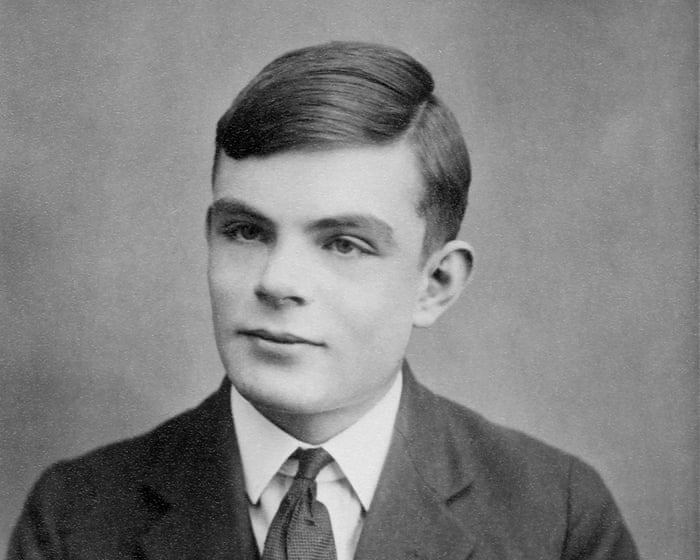

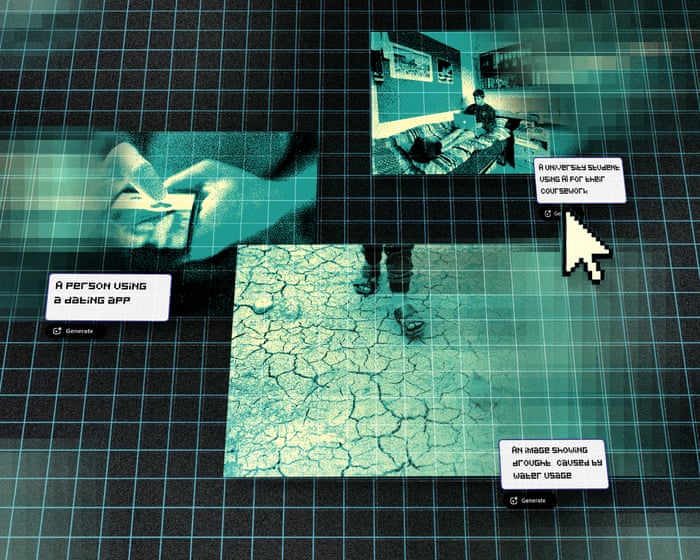

若到2025年人工智能尚未改变你的生活,那么接下来这一年它几乎必然会带来变革。这是在这个充满不确定性的时代里,我们能够笃定做出的少数预测之一。但这并非意味着你应该全盘相信那些关于该技术当前能力或未来潜力的炒作。炒作无需你的认同——硅谷资本早已将其吹捧至扭曲全球经济、激化地缘政治竞争的程度,无论人工智能最浮夸的承诺能否实现,它都在重塑我们的世界。 ChatGPT问世仅三年多,便迅速成为史上增长最快的消费级应用。如今其周活跃用户约达8亿,母公司OpenAI估值约5000亿美元。OpenAI首席执行官萨姆·奥尔特曼与行业其他参与者构建了一张复杂——在部分人看来可疑且不透明——的合作网络,旨在为美国人工智能驱动的未来搭建基础设施。这些承诺总额约1.5万亿美元。这并非实际现金,但换个角度理解:若你每秒花费1美元,需耗时3.17万年才能耗尽1万亿美元。 字母表(谷歌母公司)、亚马逊、苹果、Meta(前身为脸书)以及持有OpenAI 1350亿美元股份的微软,都在向这场豪赌投入数千亿美元。若无这些投资,美国经济很可能陷入停滞。 研究过历次工业狂热(从19世纪铁路建设到互联网泡沫兴衰)的经济分析师与历史学者,将人工智能称为泡沫。奥尔特曼本人曾坦言:"我认为人工智能的许多领域目前确实存在泡沫。"当然,他未将自身领域纳入此列。亚马逊创始人杰夫·贝索斯也称之为泡沫——但属于能加速经济进步的"良性"泡沫。依此观点,良性泡沫能为基础设施融资,拓展人类知识,即便破裂后仍能留下持久效益,从而让途中受损的"小人物"成为合理代价。 科技界的乐观主义是传统推销术、财阀式浮夸与乌托邦意识形态的强力混合体。其核心是营销话术:当前人工智能模型已在诸多任务中超越人类。按照这种思路,机器很快将实现"通用智能"——类人的认知灵活性——使人类从所有劳动中解放。一旦人工智能能自我学习并设计继任者,便将以难以想象的速度迈向超级智能。 达成此里程碑的企业将轻松偿债。推动这一愿景的引领者——目前所有核心布道者均为男性——之于全知人工智能,犹如古代先知之于神明。这对他们而言堪称非凡角色。而我们其他人在这种"后智人"秩序中的命运,则显得模糊许多。 美国并非唯一投资人工智能的超级大国,因此硅谷追求极限能力的行为牵动地缘政治博弈。中国选择了不同路径,部分源于其集中式产业规划传统,部分由于在创新领域处于追赶状态。中国政府正推动稍欠先进但仍强大的人工智能在经济与社会中更快更广地应用。中国押注于日常人工智能带来的广泛提升,而美国则致力于实现向通用智能的颠覆性跨越。 以全球主导地位为奖赏,双方均无足够动力担忧风险或接受限制人工智能应用、要求开发透明的国际规则。中美都不愿让具有战略意义的产业受制于与外国竞争对手共同制定的标准。 在全球监管缺位的情况下,我们只能依赖当代垄断巨头与威权官僚的操守,在已融入工作、娱乐、教育工具的系统内构建伦理防护栏。今年埃隆·马斯克宣布其公司正在开发面向三岁儿童的AI聊天机器人Baby Grok。该机器人的成人版本曾宣扬白人至上主义观点,甚至自称"机械希特勒"。虽然骇人听闻,但此类露骨表述至少诚实——它们比那些未如马斯克算法般受意识形态公然操控、却暗藏微妙偏见的其他AI系统更易识别。 并非所有AI系统都如Grok般属于大语言模型,但所有此类模型都易从训练数据中习得幻觉与偏见。它们并非像人类那样真正"理解"或"思考"问题,而是接收指令后,根据训练数据计算特定词汇共现的概率,继而生成看似合理的回应。结果往往准确可信,但也可能完全荒谬。随着AI生成内容充斥网络,模型训练数据中有用信息与低质"废料"的平衡被打破,意味着它们正摄入越来越多垃圾信息——因而无法被信赖来产出可靠信息。 若此趋势持续,我们可能滑向黯淡未来:由反映硅谷少数权贵偏见与自我的AI系统塑造的合成人造现实。但这并非必然结局。当前由过度狂热鼓吹者及其与特朗普政府等政治利益结盟所助长的人工智能炒作,本质是人类贪婪与短视的故事——而非某种不可阻挡的技术演进。正在创造的人工智能令人惊叹却缺陷深重,映射着其创造者的短板——他们更擅长营销与金融工程,而非构建真正智能的系统。 真正的泡沫不在股价,而在于这个自认距神明般计算能力仅一步之遥的行业膨胀的自我意识。当泡沫破裂、美国过热经济降温时,更理性的声音将有机会塑造人工智能的风险管控与监管体系。这一刻或许不会在2026年到来,但终将临近——那时我们必须直面清晰而不可避免的选择:是建造人工智能服务人类的世界,还是人类服务人工智能的世界?回答这个问题,我们不需要ChatGPT。 **常见问题解答** 人工智能泡沫·人类掌控 **初级问题** **何为人工智能泡沫?** 指当前对人工智能的狂热炒作、巨额投资及天价估值可能不可持续,类似过往科技泡沫。若泡沫破裂,将随之出现市场调整与投资降温期。 **此处的"重掌控制权"何意?** 意指若人工智能狂热降温,社会可更从容、更少仓促地探讨如何整合人工智能。焦点可从纯粹利润与速度转向人类监督、伦理规范、就业影响及制定明确规则。 **这是否在否定人工智能?** 未必。更多是关注其发展节奏与炒作现象。担忧在于泡沫催生优先快速部署、而忽视风险安全及社会影响的审慎考量。 **人工智能泡沫有哪些迹象?** 媒体极端炒作、企业为提振股价在名称中添加AI标签、未经证实的构想获巨额融资、错失恐惧症主导决策、以及可能不切实际的近期通用人工智能承诺。 **人工智能泡沫破裂会终止AI发展吗?** 不会。可能减缓基于狂热投资与炒作项目的失控发展节奏。严肃务实且可持续的人工智能研究与应用将继续推进,但会受到更严格审视。 **中高级问题** **泡沫破裂如何实际助我们重掌控制权?** 发展放缓可创造以下空间:...